10 Minuten

Meta entwickelt "Name Tag" für Smart Glasses — eine Einführung

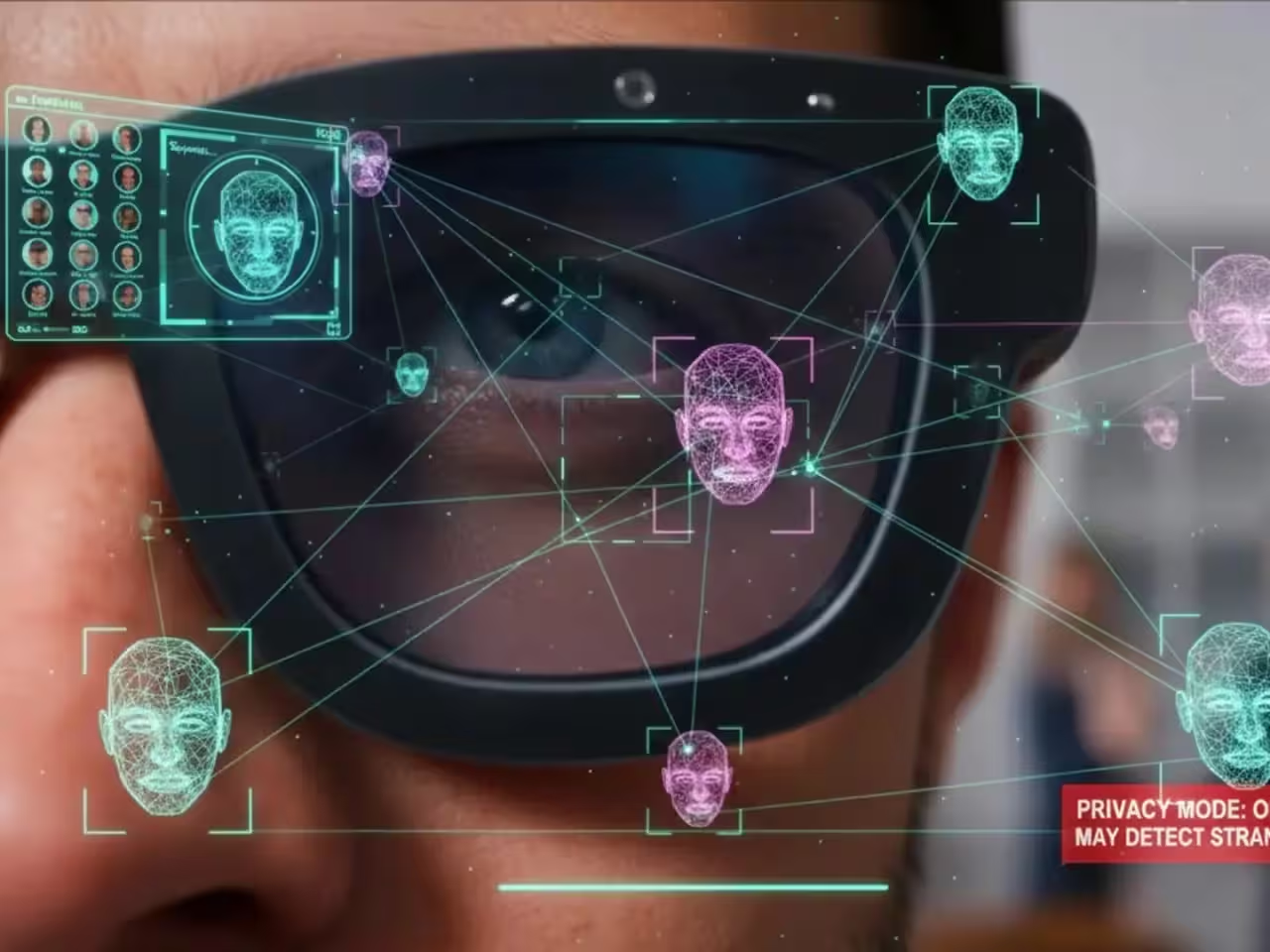

Stellen Sie sich vor, Sie gehen eine belebte Straße entlang und Ihre Brille flüstert leise einen Namen. Klingt nach Science-Fiction. Oder nach Überwachung?

Neue Recherchen der New York Times berichten, dass Meta stillschweigend an einer Funktion namens Name Tag arbeitet, die es seinen Smart Glasses erlauben würde, Personen über einen on-device KI-Assistenten zu identifizieren. Diese Information stammt aus einem internen Dokument, das der Zeitung vorlag. Dem Memo zufolge plante Meta, die Funktion zu einem Zeitpunkt einzuführen, an dem Regulierungsbehörden und Bürgerrechtsorganisationen durch andere Auseinandersetzungen abgelenkt seien – eine zeitliche Entscheidung, die Datenschützer beunruhigt.

Wie Name Tag laut Dokument funktionieren soll

Das Dokument erklärt, dass Name Tag nicht als uneingeschränkter Gesichtsscanner gedacht sei. Stattdessen solle das System sich zunächst auf Personen konzentrieren, denen ein Nutzer bereits auf Meta-Plattformen begegnet ist, oder auf Personen mit öffentlichen Profilen auf Diensten wie Instagram. Anders gesagt: Meta prüfe offenbar Beschränkungen vor – Kontakte und öffentliche Accounts identifizieren, nicht jede Person auf der Straße. Grenzen auf dem Papier reduzieren jedoch nicht automatisch die praktischen Risiken.

Partnerschaften, Markteinführung und Zielgruppen

Meta hat bereits mit bekannten Brillenmarken wie Ray-Ban und Oakley für seine AR-Hardware zusammengearbeitet. Das Unternehmen plant offenbar, Name Tag noch in diesem Jahr auf den Markt zu bringen. Ein früher Plan sah sogar vor, die Funktion zunächst auf einer Konferenz für blinde und sehbehinderte Nutzer vorzustellen, bevor sie breiter verfügbar gemacht wird — eine Entscheidung, die eine zentrale Spannung des Produkts verdeutlicht: Wer profitiert? Wer wird exponiert?

Zielgruppe und Barrierefreiheit

Die Idee, Menschen mit Sehbehinderung durch automatische Namensansagen mehr Teilhabe und Unabhängigkeit zu ermöglichen, ist nachvollziehbar. Technologien, die Barrieren verringern, sind ein wichtiger gesellschaftlicher Nutzen von KI und AR (Augmented Reality). Gleichzeitig wirft die Ausrichtung auf diese Zielgruppe ethische Fragen auf: Wird die Funktion primär als Hilfsmittel entwickelt oder als Feature, das breiter vermarktet und letztlich zur Mainstream-Überwachung beiträgt?

Aussagen von Meta und die öffentliche Reaktion

Erin Logan, eine Sprecherin von Meta, reagierte zurückhaltend auf die Berichte und sagte gegenüber The Verge, Meta entwickle Produkte, um Menschen zu verbinden und ihr Leben zu bereichern. Sie fügte hinzu, dass zwar Interesse an Funktionen wie Name Tag bestehe und ähnliche Produkte bereits auf dem Markt seien, Meta jedoch weiterhin Optionen prüfe und sorgfältig vorgehen wolle, bevor etwas veröffentlicht werde.

Diese vorsichtige Wortwahl steht in einem größeren Kontext: Meta hat in der Vergangenheit bereits Erfahrungen mit Kritik und rechtlichen Problemen im Bereich biometrischer Daten gemacht. Die öffentliche Kommunikation versucht, Vertrauen aufzubauen, doch viele Beobachter fordern konkrete technische Limitierungen, unabhängige Audits und klare Datenschutzgarantien.

Rechtliche Vorgeschichte und regulatorische Risiken

Die zurückhaltende Rhetorik erklärt sich aus einer Geschichte rechtlicher Gegenwinde. Meta geriet 2017 in Schwierigkeiten, nachdem automatische Gesichtstags in Facebook-Fotos eingeführt wurden, und stellte das biometrische Tagging 2021 unter Druck schließlich ein. Dennoch scheint das Unternehmen nun über einen Umweg über Brillen wieder auf das Thema Gesichtserkennung zurückzukommen. Leaks vom vergangenen Jahr deuteten zudem auf einen sogenannten Super-Sensing-Modus hin — einen Always-on-Kamerazustand, der die Umgebung eines Nutzers kontinuierlich überwachen und Namen ausrufen könnte.

Relevante Rechtsrahmen

In vielen Jurisdiktionen könnten solche Funktionen regulatorische Hürden auslösen. Die Datenschutz-Grundverordnung (DSGVO) in der EU stellt strenge Anforderungen an die Verarbeitung biometrischer Daten zur Identifikation natürlicher Personen. In den USA bestehen auf Bundesebene weniger klare Regeln, doch einzelne Bundesstaaten wie Illinois mit dem Biometric Information Privacy Act (BIPA) haben bereits rechtliche Schritte gegen Firmen wegen biometrischer Gesichtserkennung ausgelöst. Solche Gesetze können enorme Bußgelder und Klagen nach sich ziehen.

Datenschutz- und Sicherheitsrisiken

Änderungen in Metas Datenschutzrichtlinien deuten darauf hin, dass KI auf Brillen aktiv bleiben könnte, bis der Nutzer sie ausdrücklich mit einem manuellen Befehl wie 'Hey Meta' deaktiviert. Das wirft eindeutige Bedenken auf: Ständige Sensorik gekoppelt an ein riesiges soziales Netzwerk oder Datenbanken öffentlicher Accounts schafft Möglichkeiten für unbeabsichtigtes Tracking, Doxxing oder Fehlidentifikationen. Für eine Technologie, die als Barrierefreiheits-Verbesserung für blinde oder sehbehinderte Nutzer angepriesen werden könnte, sind die Risiken besonders hoch.

Praktische Gefahren

- Unbeabsichtigtes Tracking: Dauerhafte Erfassung von Bewegungsprofilen und sozialen Interaktionen.

- Doxxing und Stalking: Verbindung öffentlich zugänglicher Profilinformationen mit Echtzeit-Standorten kann Missbrauch erleichtern.

- Fehlidentifikation: KI-Modelle machen Fehler — falsche Namen können soziale Konflikte, Übergriffe oder Diskriminierung nach sich ziehen.

- Bias und Diskriminierung: Gesichtserkennungssysteme zeigen in Studien oft schlechtere Erkennungsraten für Frauen und Menschen mit dunklerer Hautfarbe.

Technische Details und Implementierungsfragen

Die beschriebenen Architekturen deuten auf eine on-device-Analyse hin: eine Verarbeitung lokal auf dem Brillencomputer, statt Übermittlung der Rohdaten in die Cloud. On-Device-Erkennung kann Datenschutzvorteile bringen, weil Bilder und Modelle nicht fortlaufend an Server gesendet werden. Dennoch stellt sich die Frage, welche Referenzdatenbanken verwendet werden — die Kontakte eines Nutzers, öffentliche Meta-Profile, externe Datenbanken? Die Quelle der Vergleichsdaten bestimmt maßgeblich die Risiken der Funktion.

Datenquellen und Modelltraining

Wesentliche technische Unterscheidungen:

- Persönliche Kontakte: Daten, die Nutzer explizit erstellt oder autorisiert haben (z. B. eigene Freunde auf Meta-Plattformen).

- Öffentliche Profile: Inhalte und Metadaten von Accounts, die als öffentlich markiert sind (z. B. öffentliche Instagram-Profile).

- Externe Datensätze: Große Trainingsdatenbanken, die aus dem Web oder Drittanbietern aggregiert wurden — hier sind Transparenz und Einwilligung oft problematisch.

Wenn das System nur auf persönliche Kontakte und freiwillig veröffentlichte öffentliche Profile zugreift, lässt sich das Risiko reduzieren. Jedoch bleibt die Frage, wie leicht Nutzer aus diesen Quellen entfernt werden können, wie Alterseinschränkungen und Sperrlisten gehandhabt werden und welche Kontrolle Dritte über ihre Daten haben.

Alternativen und Präzedenzfälle

Es gibt Alternativen und bereits existierende Vorbilder. Firmen wie Envision, in Zusammenarbeit mit Solos, bieten assistive Brillen an, die den Nutzer zwingen, ein Foto aufzunehmen und in einer App manuell jemanden zu taggen, bevor eine Erkennung erfolgt. Dieses Design kehrt das Machtverhältnis um: Die Kontrolle liegt beim Träger, nicht bei einem permanenten automatischen Scanner.

Designprinzipien für verantwortungsvolle Implementierung

- Explizite Zustimmung: Nutzer und getaggte Personen sollten klar zustimmen können, bevor Identifikationsdaten verwendet werden.

- Transparenz: Offenlegung, welche Datenquellen genutzt und wie lange Daten gespeichert werden.

- Lokale Verarbeitung: Verarbeitung auf dem Gerät, um Übertragung sensibler Rohbilder zu vermeiden.

- Aus-Schalter und Granulare Kontrollen: Einfacher, sofortiger physischer Aus-Schalter und feingranulare Privatsphäreeinstellungen.

- Externe Audits: Unabhängige Prüfungen von Algorithmen und Datenschutzprozessen.

Argumente für und gegen Name Tag

Meta wird die Vorteile betonen: schnellere soziale Erkennung, mehr Unabhängigkeit für sehbehinderte Nutzer, freihändige Bequemlichkeit im Alltag. Diese Nutzenargumente sind nicht zu unterschätzen — Technologien, die Teilhabe erhöhen, können echten Mehrwert bringen.

Kritiker hingegen verweisen auf sogenannte Mission Creep (schleichende Ausweitung eines ursprünglich begrenzten Zwecks), mangelhafte Schutzmaßnahmen und die realen Machtverhältnisse, die entstehen, wenn Fremde in der Öffentlichkeit identifiziert werden können. Die Frage, welche Seite das Endprodukt prägt, hängt womöglich weniger von der Technik als von Recht, öffentlichem Druck und einer oft unangenehmen gesellschaftlichen Debatte darüber ab, was wir wollen, dass unsere Brillen tun.

Wer profitiert, wer ist gefährdet?

Interessensgruppen:

- Sehbehinderte und blinde Menschen: Potenzieller direkter Nutzen durch bessere Orientierung und soziale Interaktion.

- Kommerzielle Akteure: Anbieter von Hardware, Werbekunden und Datenverarbeitern sehen wirtschaftliche Chancen.

- Datenschutzaktivisten und Bürgerrechtsgruppen: Befürchten Missbrauch, Privatsphärenverstöße und verstärkte Überwachung.

- Regulierungsbehörden: Müssen abwägen, ob neue Regeln nötig sind, um Missbrauch zu verhindern.

Wichtig ist, dass Vorteile und Risiken nicht linear verteilt sind. Menschen, die ohnehin marginalisiert sind, könnten unverhältnismäßig stark durch Fehlidentifikationen oder Überwachung leiden. Umgekehrt könnten einige Nutzergruppen große Vorteile erfahren, wenn strikte Schutzmechanismen implementiert und durchgesetzt werden.

Regulatorische und ethische Empfehlungen

Aus Sicht von Datenschutzexperten und Ethikforschern sollten folgende Maßnahmen diskutiert und where möglich implementiert werden:

- Klare gesetzliche Vorgaben für die Verarbeitung biometrischer Daten, einschließlich Zweckbindung und Löschpflichten.

- Vorgaben für Transparenz gegenüber Dritten, deren Daten genutzt werden (z. B. öffentliche Profile).

- Technische Standards für Bias-Tests und Genauigkeitsanforderungen, bevor Systeme weit verbreitet werden dürfen.

- Recht auf Widerspruch und einfache Verfahren zum Ausschluss aus Datensätzen.

Fazit und Ausblick

Die Debatte um Meta's angebliches Name Tag zeigt zentrale Spannungsfelder der Gegenwartstechnologie: der legitime Wunsch, Barrieren zu reduzieren und Alltagshilfen zu bieten, trifft auf berechtigte Ängste vor Überwachung, Missbrauch und systematischer Benachteiligung. Technisch sind Lösungen denkbar, die Risiken mindern — lokale Verarbeitung, Einwilligungsschemata, granular einstellbare Optionen und externe Prüfungen. Entscheidend wird jedoch sein, ob Unternehmen, Gesetzgeber und Zivilgesellschaft gemeinsam Regeln und Normen entwickeln, die Vertrauen herstellen.

Ob Name Tag überhaupt in der vorgeschlagenen Form auf den Markt kommt, bleibt offen. Vielmehr wird die Entwicklung dieses Features zeigen, wie wir als Gesellschaft Prioritäten setzen: Sicherheit und Privatsphäre, oder Komfort und Kommerz? Die Diskussion, die jetzt beginnt, wird darüber entscheiden, welche Rolle unsere Brillen in Zukunft spielen — Helfer, Überwachungsinstrument oder beides zugleich.

Weitere Fragen entstehen: Wie lassen sich Nutzungsfälle genau begrenzen? Welche technischen und juristischen Mechanismen sind nötig, um Missbrauch zu verhindern? Und wie können betroffene Gruppen, insbesondere Menschen mit Sehbehinderungen, an der Entwicklung und Entscheidungsfindung beteiligt werden? Diese Debatten sind nicht nur technisch, sondern zutiefst politisch und kulturell – und sie verdienen breite Öffentlichkeit und fundierte regulatorische Antworten.

Quelle: smarti

Kommentar hinterlassen