7 Minuten

Einführung

Sprich mit deinem Telefon, als wäre es ein hilfsbereiter Mitbewohner. Samsung hat still und heimlich das Handbuch für Bixby neu geschrieben und dem Assistenten einen neuen Jobtitel verpasst: konversationeller Geräte‑Agent. Die fünfte One UI 8.5 Beta erschien zusammen mit dem Android‑Sicherheitsupdate für Februar, und in diesem Update steckt das nächste Bixby‑Upgrade, auf das Samsung schon hingedeutet hatte.

Was ändert sich?

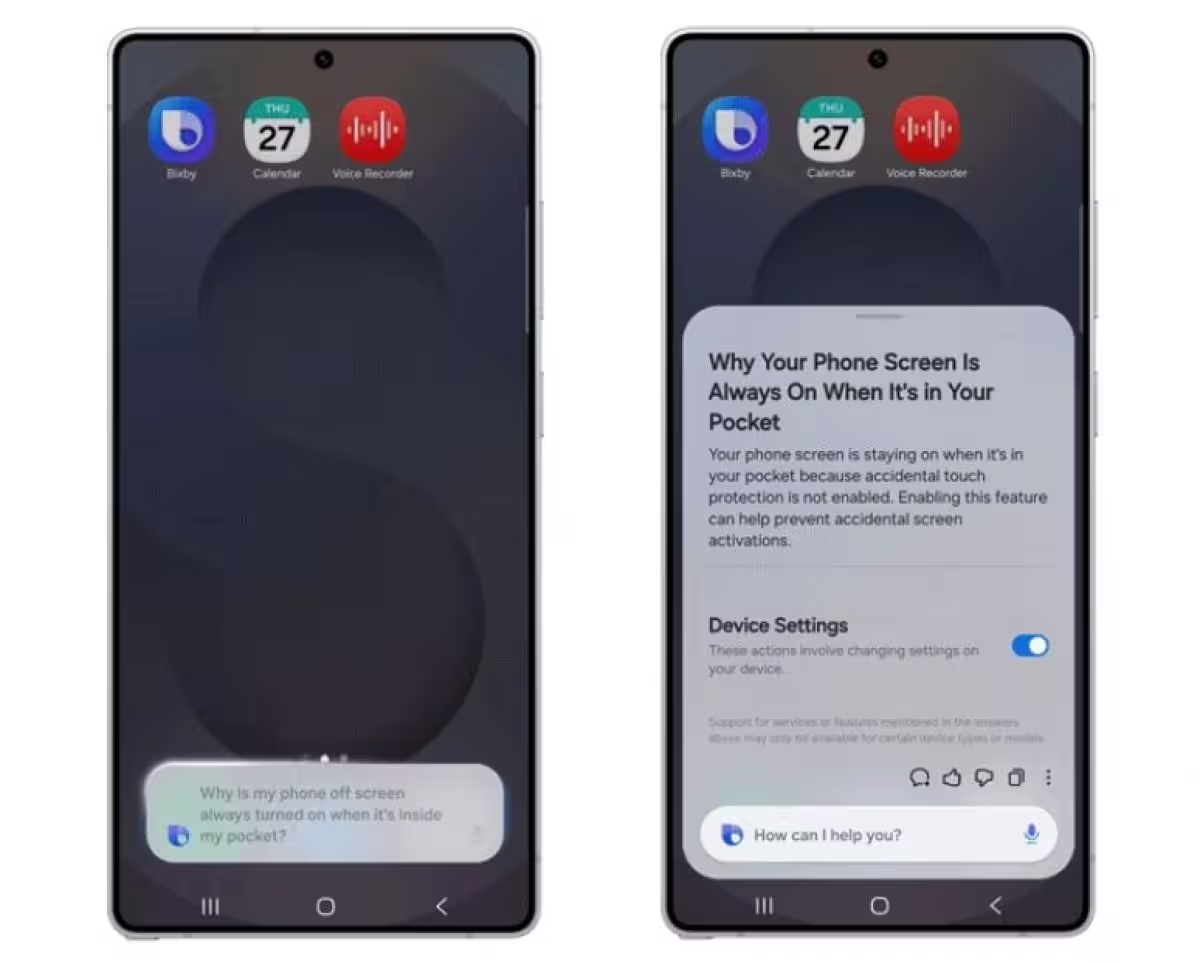

Für den Anfang reichen die natürlichsprachlichen Steuerungen deutlich tiefer ins Gerät hinein. Wenn du nicht möchtest, dass sich der Bildschirm beim Lesen automatisch abdunkelt, genügt ein kurzer Hinweis und Bixby ändert die Einstellung so, dass das Display anbleibt, solange du es ansiehst. Das mag klein erscheinen, ist aber praktisch und auf bemerkenswerte Weise befreiend: kurze Befehle, komplexes Verhalten. Der Assistent schlägt eine Brücke zwischen umgangssprachlichen Anweisungen und präzisen Geräteaktionen.

Natürlichsprachliche Steuerung und tiefere Integration

Die Kerninnovation liegt in der Intentionserkennung kombiniert mit direktem Zugriff auf Systemeinstellungen und App‑Funktionen. Anstatt eine Liste möglicher Sprachbefehle zu durchlaufen, interpretiert Bixby freie Sprache und führt mehrere Schritte aus — etwa Helligkeit anpassen, Bildschirm‑Timeout deaktivieren und eine Lesemodus‑Einstellung aktivieren — alles in einem konversationellen Kontext. Diese Art der Steuerung reduziert Menünavigation und sorgt dafür, dass Nutzer tasks statt Menüpfade im Kopf behalten müssen.

Beispiele und praktische Nutzung

Konkrete Anwendungsfälle zeigen die Nützlichkeit: „Lass den Bildschirm an, solange ich lese“ oder „Sorge dafür, dass mein Wecker nur werktags klingelt und die Lautstärke reduziert ist“ — solche Anfragen lösen eine Kette von Anpassungen aus. Für Power‑User bedeutet das Kombinationsbefehle, für Gelegenheitsnutzer eine natürlichere, weniger fehleranfällige Interaktion.

Verbesserte Suche und Live‑Ergebnisse

Auch das Suchverhalten hat sich weiterentwickelt. Bixby kann das Web in Echtzeit abfragen und aktuelle Ergebnisse direkt in seiner Oberfläche anzeigen. Das bedeutet: Antworten sind frischer, Folgefragen klingen weniger starr — man wartet nicht mehr auf vorgefertigte Phrasen, sondern erhält live eingewobene Informationen innerhalb des Gesprächsverlaufs.

Technik hinter den Live‑Ergebnissen

Die Integration externer Webquellen erfolgt in der Regel über gesicherte APIs und Suchendpunkte. Bixby kombiniert lokale semantische Modelle für die Sprachverarbeitung mit Remote‑Abfragen, wenn aktuelle oder zeitabhängige Daten benötigt werden (z. B. Nachrichten, Wetterdaten, Börsenkurse). Dieser Hybridansatz soll Latenz niedrig halten, ohne auf Aktualität verzichten zu müssen.

Kontextbeibehalt und Follow‑up‑Fragen

Ein wichtiger Fortschritt ist die Fähigkeit, Kontext über mehrere Nachfragen hinweg zu halten. Anstatt jedes Mal neu zu starten, versteht Bixby Bezugsgrößen aus dem Gesprächsverlauf — etwa dass „das“ auf einen zuvor genannten Artikel verweist — und liefert dadurch fluide Interaktionen, die sich eher wie ein Gespräch und weniger wie eine Abfolge einzelner Befehle anfühlen.

Verfügbarkeit und Rollout

Wenn du die One UI 8.5 Beta 5 installiert hast, kannst du diese neue Erfahrung heute testen. Die Verfügbarkeit ist vorerst allerdings begrenzt: Deutschland, Indien, Korea, Polen, das Vereinigte Königreich und die USA stehen auf der frühen Liste, während Samsung einen breiteren Rollout plant. Das Unternehmen gibt an, dass One UI 8.5 und das aufgerüstete Bixby offiziell zusammen mit der Galaxy S26‑Serie am 25. Februar erscheinen werden.

Beta‑Test und Nutzerfeedback

Beta‑Programme dienen dazu, reales Nutzerfeedback über unterschiedliche Regionen und Nutzungsgewohnheiten einzusammeln. Samsung wird vermutlich Telemetrie‑Daten (mit opt‑in/opt‑out‑Optionen), Fehlerrückmeldungen und Nutzungsmuster auswerten, um Sprachmodelle, Intent‑Erkennung und Lokalisierung weiter zu verbessern, bevor die Funktion global verteilt wird.

Warum das wichtig ist

Assistenten, die Hardware mit Alltagssprache steuern, verändern die Art, wie wir mit Geräten interagieren. Sie vermindern Reibung und lassen dich auf Aufgaben konzentrieren statt auf Menüs. Datenschutz und Genauigkeit werden die eigentlichen Prüfsteine sein — und wie Samsung die Balance zwischen On‑Device‑Verarbeitung, Cloud‑Abfragen und sichtbaren Kontrollen gestaltet, entscheidet darüber, ob diese Neuerung als Komfort oder als Eingriff empfunden wird.

Datenschutz und On‑Device‑Verarbeitung

Ein zentrales Thema ist die Aufteilung von Verarbeitungsschritten zwischen Gerät und Cloud. Lokale Modelle können private Absichten und sensible Steuerbefehle verarbeiten, ohne Daten zu übertragen, während Cloud‑Dienste für große Modellinferenz und aktuelle Webdaten genutzt werden. Transparente Hinweise, welche Anfragen lokal bleiben und welche in die Cloud gehen, sowie einfache Einstellungen zum Deaktivieren von Web‑Suchen sind entscheidend, um Vertrauen zu schaffen.

Genauigkeit, Bias und Korrekturmöglichkeiten

Sprachmodelle können Fehler machen oder Bedeutungen falsch deuten, insbesondere bei Dialekten, Fachsprache oder mehrdeutigen Formulierungen. Eine sinnvolle Nutzerführung umfasst sichtbares Feedback („Ich habe verstanden, du willst ...“), einfache Undo‑Optionen und Korrekturpfade. So bleibt Kontrolle beim Nutzer und die wahrgenommene Genauigkeit steigt.

Leistung, Latenz und Energieverbrauch

Intensivere Sprachverarbeitung und Live‑Web‑Anfragen haben Auswirkungen auf Latenz und Akkuverbrauch. Hersteller müssen optimieren: sparsame lokale Modelle für einfache Intents, asynchrone Cloud‑Abfragen für komplexe Recherchen und adaptive Netzwerknutzung, um Performance und Energieeffizienz in Einklang zu bringen.

Technische und praktische Implikationen

- Integrationsgrad: Tieferer Zugriff auf Systemeinstellungen und App‑Funktionen erlaubt komplexe, zusammengesetzte Befehle.

- Kontext‑Management: Kontinuierlicher Kontext über mehrere Anfragen erhöht die Gesprächsqualität.

- Hybrid‑Architektur: Kombination aus On‑Device‑Modellen und Cloud‑Diensten für Aktualität und Skalierung.

- Transparenz: Klare Anzeigen, wenn Daten in die Cloud geschickt werden, und einfache Privacy‑Kontrollen.

Vergleich mit anderen Assistenten

Google Assistant, Siri und Alexa haben bereits fortgeschrittene Fähigkeiten bei Suche, Home‑Integration und Routine‑Automatisierung. Samsungs Schritt, Bixby als „konversationellen Geräte‑Agenten“ zu positionieren, setzt einen Fokus auf native Gerätesteuerung per Alltagssprache kombiniert mit Live‑Webantworten — ein Unterscheidungsmerkmal gegenüber Assistenten, die stärker auf cloudbasierte Ökosysteme oder Smart‑Home‑Integration ausgerichtet sind. Die tatsächliche Wettbewerbsfähigkeit hängt davon ab, wie gut Samsung Latenz, Privatsphäre und Genauigkeit balanciert.

Tipps zum Testen in der Beta

Wenn dein Telefon zur Beta‑5‑Gruppe gehört, probiere verschiedene Kategorien von Befehlen aus: Systemeinträge (Helligkeit, Bluetooth, Bildschirm‑Timeout), App‑Aktionen (Nachricht senden, Playlist starten), sowie kombinierte Anfragen mit Bedingungen („Wenn es regnet, stelle Erinnerungen für Regenschirm ein“). Achte darauf, wie Bixby Rückfragen stellt, wie oft Web‑Daten genutzt werden und welche Kontrollmöglichkeiten dir angeboten werden.

Fehlermeldungen und Feedback geben

Nutze die Feedback‑Tools im Beta‑Programm, um Fehlinterpretationen, fehlerhafte Aktionen oder Datenschutz‑Bedenken zu melden. Detailliertes, konstruktives Feedback hilft den Entwicklern, Modelle und UX schneller zu verbessern.

Fazit und Ausblick

Kurz gesagt: Bixby verschiebt sich von einem reinen Sprachhelfer hin zu einem proaktiven Geräte‑Agenten, der natürlichsprachliche Steuerung mit tagesaktuellen Webantworten kombiniert. Erstmals ergibt sich eine näher an menschlicher Konversation orientierte Interaktion, die gleichzeitig präzise Hardware‑Kontrolle ermöglicht.

Erwarte Iteration und eine schrittweise Erweiterung der regionalen Verfügbarkeit. Wenn dein Gerät zur Beta‑5‑Gruppe gehört, probiere ein Gespräch aus — und berichte von deinen Erfahrungen. Für Entwickler und Datenschützer bleibt die Balance zwischen lokalem Datenschutz, Cloud‑Funktionalität und transparenter Nutzerkontrolle das zentrale Thema, das über Erfolg oder Ablehnung dieser Neuerung entscheiden wird.

Praktisch gesehen eröffnen sich neue Möglichkeiten für barrierefreie Bedienung, produktivere Arbeitsabläufe und intuitivere Alltagshilfen — vorausgesetzt, die Implementierung respektiert Nutzerwahl, Privatsphäre und technische Limitationen.

Quelle: gsmarena

Kommentar hinterlassen