10 Minuten

OpenAI hat ChatGPT Images in ein deutlich schnelleres und präziseres Kreativwerkzeug verwandelt. Das überarbeitete Bildmodell verspricht schnellere Generierungen, treuere Bearbeitungen und neue Presets, die Bilderstellung auch ohne detaillierte Texteingaben zugänglich machen. Dieses Update erscheint zeitgleich mit GPT-5.2 und positioniert ChatGPT Images als schärferen Konkurrenten zu Lösungen wie Googles Nano Banana Pro. Für Nutzer von KI-Bildgenerierung, Designer und Content-Creator bringt die neue Version sowohl Performance- als auch Workflow-Verbesserungen.

Geschwindigkeit und Intention: Was sich unter der Haube geändert hat

Die wichtigste Neuerung ist die rohe Geschwindigkeit: Die Bildgenerierung läuft nun etwa viermal schneller als zuvor. Geschwindigkeit bedeutet hier allerdings nicht nur geringere Latenzzeiten beim Erstellen einzelner Bilder, sondern auch eine verkürzte Gesamtdauer für mehrstufige Iterationszyklen. Für professionelle Workflows, bei denen schnelle A/B-Tests oder mehrere Revisionen nötig sind, kann das den Unterschied zwischen Minuten und Stunden bedeuten.

OpenAI betont zudem, dass das Modell Nutzerintentionen zuverlässiger folgt. Statt großzügiger globaler Änderungen führt das System gezieltere Bearbeitungen aus: Es verändert in der Regel nur die angefragten Bereiche und bewahrt den Rest der Komposition. Diese verbesserte Intent-Treue reduziert die Anzahl unnötiger Korrekturschleifen und erhöht die Effizienz von Bildbearbeitung und kreativen Iterationen.

Technisch steht hinter dieser Verbesserung eine optimierte Balance zwischen Lokalisierung und globalem Kontextverständnis: Das Modell interpretiert Masken, Markierungen und sprachliche Hinweise genauer und hält relative Objektverhältnisse stabil. Das Resultat ist eine höhere Editiergenauigkeit (Edit-Fidelity) bei gleichzeitiger Reduktion ungewollter Artefakte.

Für Entwickler und Agenturen, die KI-Bildeditoren in Produktionspipelines integrieren, bedeutet das zudem stabilere API-Antwortzeiten und verlässlichere Änderungsprognosen. Bei großen Kampagnen oder zahlreichen Assets skaliert diese Konsistenz direkt in Zeit- und Kostenersparnis.

Praktische Auswirkungen auf Workflows

Die vierfache Beschleunigung der Generierungszeit eröffnet neue Möglichkeiten für interaktive und iterative Workflows: Live-Workshops mit Kund:innen, schnelle Prototypen in Design-Sprints oder Social-Media-Teams, die tagesaktuelle Grafiken benötigen. Kurz gesagt: KI-Bildgenerierung nähert sich in dieser Version dem Tempo realer Kreativteams an.

Zusätzlich verbessert sich die Vorhersagbarkeit bei Folgeanfragen: Wenn etwa eine Reihe kleiner Anpassungen an einem Produktbild erforderlich ist, bleiben Komposition, Beleuchtung und räumliche Beziehungen zwischen Objekten konsistent. Das reduziert den Anpassungsaufwand, weil weniger manuelle Nachbearbeitung in klassischen Bildeditoren nötig wird.

Technische Hinweise zur Latenz und Infrastruktur

OpenAI nennt keine exakten Hardwareanforderungen, weist aber darauf hin, dass die schnellere Performance durch Model-Optimierungen und Laufzeitverbesserungen erreicht wurde. In der Praxis sollten Anwender:innen mit moderner Cloud-Infrastruktur (GPU-basierte Instanzen) ähnliche Verbesserungen sehen, während lokale Clients von Server-seitigen Beschleunigungen profitieren. Diese Architektur unterstreicht den Trend zu multimodalen KI-Systemen, bei denen Sprach- und Bildmodelle gemeinsam optimiert werden — besonders relevant im Kontext von GPT-5.2.

Für Unternehmen, die auf niedrige Latenz angewiesen sind (z. B. interaktive Web-Tools oder mobile Apps), empfiehlt sich das Testen mit repräsentativen Lastprofilen, um eventuelle Netzwerk- und API-Overhead-Effekte zu messen. Die schnellere Modelldurchlaufzeit ist ein zentraler Vorteil, ebenso wie die gestiegene Stabilität bei sequentiellen Edit-Anfragen.

Editing-Genauigkeit trifft kreative Flexibilität

Über die reine Geschwindigkeit hinaus schärft das Update mehrere Kernfähigkeiten des Bildmodells. Die KI ist deutlich besser darin, Elemente hinzuzufügen oder zu entfernen, mehrere Konzepte zu verschmelzen und Merkmale von einer Bildregion in eine andere zu übertragen, ohne die räumlichen Beziehungen zwischen Objekten zu zerstören. Diese Verbesserungen stärken sowohl die kreative Flexibilität als auch die Verlässlichkeit bei präzisen Bildbearbeitungen.

Ein wichtiger Aspekt ist die Fähigkeit, verschiedene Stil- und Inhaltskonzepte sauber zu kombinieren: Ob realistische Produktaufnahmen mit stilisierten Hintergründen, oder Porträts mit gezielt angepasster Stimmung — das Modell erhält Beziehungen wie Lichtquelle, Schatten und Perspektive über Transformationen hinweg. Ergebnis sind Anpassungen, die die ursprüngliche Bildstimmung erhalten, während gezielte Änderungen vorgenommen werden.

Für Designer bedeutet dies, dass generierte Varianten nicht mehr grundlegend neu aufgebaut werden müssen, sondern als echte Revisionen fungieren. So lassen sich Moodboards, Iterationsprotokolle und Versionierungssysteme effizienter einsetzen, da die KI-Kohärenz zwischen Versionen höher ist.

Aus technischer Sicht hat OpenAI offenbar Verbesserungen in der latenten Repräsentation von Objekten und Szenen vorgenommen, wodurch semantische Attribute stabiler übertragen werden können. Das ist besonders nützlich, wenn Features wie Texturen, Muster oder kleine Details an unterschiedlichen Positionen repliziert werden sollen, ohne unnatürliche Verzerrungen zu erzeugen.

Die höhere Präzision bei der Positionierung und Komposition reduziert den Bedarf an manuellen Masken und aufwändigen Retusche-Schritten, die bei früheren Modellen oft notwendig waren. In Kombination mit verbesserten Presets und Suggestion-Card-Mechaniken (siehe unten) ergibt das ein Workflow-Ökosystem, das sowohl für Profis als auch für Gelegenheitsanwender:innen attraktiv ist.

Werkzeuge für sofortige Inspiration

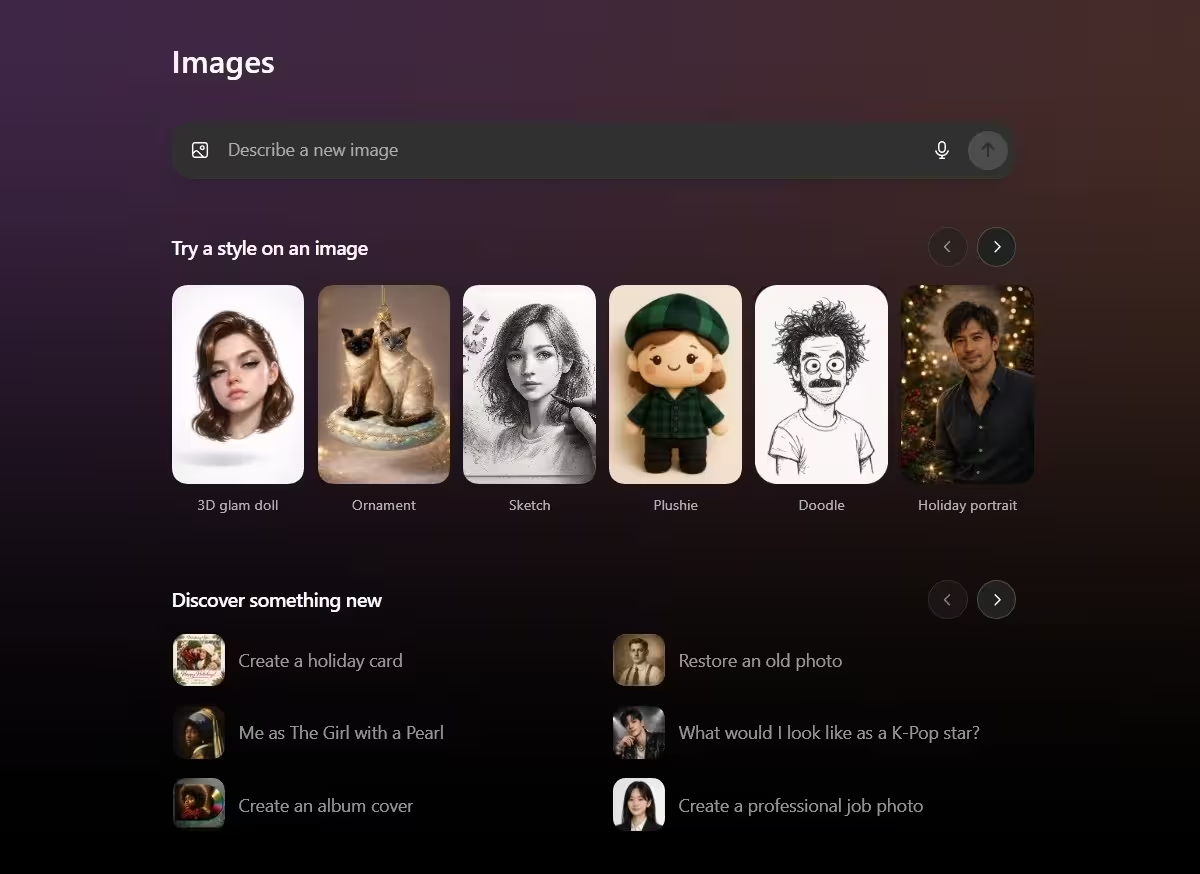

ChatGPT Images enthält jetzt integrierte Preset‑Stile und Vorschlagskarten, die Nutzer:innen anstelle eines detaillierten Prompts auswählen können. Diese Presets reichen von fotografischen Looks über illustrative Stile bis hin zu spezifischen Farbschemata und Kompositionsvorlagen. Für viele Anwender reduziert das die Einstiegshürde erheblich und beschleunigt die kreative Arbeit.

Die Suggestion Cards funktionieren dabei wie vorgefertigte Impulse: Statt lange Beschreibungen zu verfassen, wählt der Nutzer einfach eine Karte mit einem gewünschten Stil, einer Stimmung oder einem Kompositionsvorschlag. Das System kombiniert diese Auswahl mit eventuell vorhandenen Bild-Inputs und liefert innerhalb von Sekunden passende Varianten.

Zusätzlich verbessert das Modell das Text-Rendering innerhalb von Bildern, ein häufiges Problem bei KI-generierten Visuals. Korrektes und gut lesbares Text-Rendering ist wichtig für Mockups, Produktbilder und Social-Media-Grafiken. ChatGPT Images erreicht hier höhere Lesbarkeit und konsistentere Typografie-Integration, wodurch das Nachbearbeiten in externen Tools oft entfällt.

Eine weitere Schwachstelle früherer Modelle waren kleine Gesichter oder stark verkleinerte Porträts in Gruppenaufnahmen. Das Update reduziert Unschärfen und Verzerrungen bei kleinen Gesichtern und verbessert die Detailtreue, was besonders bei Lifestyle-Fotografie, Event-Dokumentation oder Szenen mit mehreren Personen relevant ist.

Für Anwender bedeutet das konkret: weniger Zeit in Retusche und mehr Zeit für kreative Entscheidungen. Für Social-Media-Manager, E‑Commerce-Teams oder Freelancer, die häufig skalierte Bildvarianten erstellen müssen, können Presets und bessere Textintegration eine spürbare Produktivitätssteigerung bedeuten.

Benutzerfreundlichkeit und Barrierefreiheit

Die neuen Presets und Suggestion Cards senken die Einstiegsbarriere für Nutzer:innen ohne tiefes Prompt‑Engineering-Wissen. Das fördert die Zugänglichkeit von KI-gestützter Bildbearbeitung für ein breiteres Publikum — von kleinen Unternehmen über Lehrende bis zu Hobbykünstler:innen. Gleichzeitig bleibt das System offen für erfahrene Benutzer, die weiterhin präzise textbasierte Prompts und Masken verwenden können.

OpenAI hat außerdem ergonomische Verbesserungen an der Benutzeroberfläche angekündigt: schnellere Vorschau-Navigation, besseres Undo/Redo-Verhalten und klarere Metadaten zu generierten Bildern (z. B. verwendete Presets, Versionsverlauf). Solche Funktionen unterstützen kollaborative Workflows und erleichtern das Nachvollziehen von Änderungen in Teamumgebungen.

Wie es sich gegen die Konkurrenz behauptet

Vergleich mit anderen Bildmodellen

- OpenAI reagierte mit diesem Release direkt auf konkurrierende Bildmodelle und versuchte, bei Editier-Genauigkeit und Generierungsgeschwindigkeit gleichzuziehen oder zu übertreffen.

- Im Vergleich zu Googles Nano Banana Pro legt ChatGPT Images verstärkt Wert auf die Kontinuität von Bearbeitungen und die Erhaltung der Nutzerintention über mehrere Revisionen hinweg.

- Das gleichzeitige Erscheinen neben GPT-5.2 unterstreicht den größeren Wettlauf in der KI-Entwicklung zwischen den großen Forschungslaboren, in dem Sprach- und Bildmodelle gemeinsam für engere multimodale Workflows optimiert werden.

Die Konkurrenzanalyse zeigt, dass verschiedene Anbieter unterschiedliche Prioritäten setzen: Einige Modelle fokussieren auf maximale kreative Freiheit und Vielfalt der Generierung, andere — wie die aktualisierte ChatGPT Images-Version — zielen auf Stabilität, Editierbarkeit und Workflow-Integration. Welches Modell für ein Projekt am besten geeignet ist, hängt daher stark von den Anforderungsprofilen ab: Brauche ich maximale Variation oder verlässliche Revisionen?

In der Praxis schlägt sich diese strategische Ausrichtung in der Produktpositionierung nieder. Teams, die Design‑Versionierung, konsistente Brand-Assets und enge Zusammenarbeit zwischen Kreativen und Produktmanager:innen benötigen, werden tendenziell die Edit-Kontinuität und Predictability von ChatGPT Images höher bewerten. Projekte mit Fokus auf experimentelle Bildästhetik und ungewöhnliche Stile könnten hingegen andere Modelle bevorzugen, die größere Varianz erzeugen.

Multimodale Integration und ökosystemische Vorteile

Die zeitgleiche Optimierung mit GPT-5.2 erlaubt OpenAI, Sprach- und Bildfunktionen näher zu verschränken. Das bedeutet praxisnah: bessere Text-zu-Bild-Übergänge, konsistentere Bildbeschreibungen und feinere Steuerungsmöglichkeiten per natürlicher Sprache. Agenturen können so multimodale Pipelines bauen, in denen Bildgenerierung, Textausgabe (z. B. Bildunterschriften) und Metadatenverwaltung miteinander verknüpft sind.

Diese enge Verzahnung von Sprachmodell und Bildmodell eröffnet neue Möglichkeiten für automatisierte Content-Workflows: automatisch generierte Bildvarianten mit passenden Captions, A/B-Test-Generationen auf Basis kurzer Briefings oder generative Produktfotografie, die sowohl Bild als auch Produktbeschreibung in einem Schritt liefert. Solche Workflows reduzieren manuelle Übergaben und erhöhen die Effizienz von Content-Produktionsketten.

Rechtliche, ethische und qualitative Aspekte

Mit größerer Leistungsfähigkeit steigen auch Erwartungen an verantwortungsvolle Nutzung. OpenAI hat in der Vergangenheit Moderationsmechanismen und Schutzfilter integriert; Nutzer:innen sollten dennoch Richtlinien für die Verwendung generierter Bilder beachten, insbesondere bei Markeninhalten, Persönlichkeitsrechten und potenziell problematischen Motiven.

Für professionelle Anwendungen ist es ratsam, klare Review-Prozesse zu etablieren: juristische Prüfung bei Markennutzung, Zustimmung bei abgebildeten Personen und Nachverfolgung der Generierungsparameter zur Reproduzierbarkeit. Solche Maßnahmen stärken die Content-Autorität und reduzieren rechtliche Risiken.

Qualitätskontrolle bleibt zentral: Trotz spürbarer Verbesserungen können Artefakte, ungewollte Verzerrungen oder inkonsistente Details auftreten — besonders bei komplexen Kompositionen oder sehr detaillierten Produktmerkmalen. Daher ist eine hybride Herangehensweise oft sinnvoll: KI-Generierung für Varianten und Vorschläge, menschliche Finalisierung für finale Assets.

OpenAI kündigt an, das neue ChatGPT Images weltweit für alle Nutzer:innen auszurollen. Das bedeutet, dass Social-Creators, Produktdesigner, Agenturen und Entwickler:innen mit schneller Iteration und detaillierteren Editierfunktionen rechnen können. Für diejenigen, die auf schnelle Iterationen oder präzise Anpassungen angewiesen sind, soll das Update das Gefühl verstärken, mit einem kooperativen Kreativpartner zu arbeiten, statt mit einem zufälligen Generator.

Abschließend bleibt festzuhalten: Die Kombination aus deutlich reduzierter Generierungszeit, verbesserter Intent-Treue und neuen Presets macht ChatGPT Images zu einem ernstzunehmenden Werkzeug in der KI-Bildbearbeitung. Teams sollten die neuen Features in realen Workflows testen, um Vorteile bei Effizienz, Konsistenz und kreativer Kontrolle systematisch zu nutzen.

Tipps für den Einstieg: Testen Sie Presets mit realen Assets, messen Sie Zeitersparnis bei Standardaufgaben, integrieren Sie Versionierung und Metadaten, und definieren Sie klare Review-Standards. So lässt sich das volle Potenzial der verbesserten KI-Bildgenerierung ausschöpfen — sowohl in kreativen Studios als auch in produktionsorientierten Umgebungen.

Quelle: gsmarena

Kommentar hinterlassen