9 Minuten

Einführung

Stellen Sie sich vor, eine Nachricht landet um 2 Uhr morgens auf dem Handy eines Elternteils: "Ihr Teenager hat nach Inhalten zur Selbstverletzung gesucht." Kurz. Schockierend. Unvermeidlich.

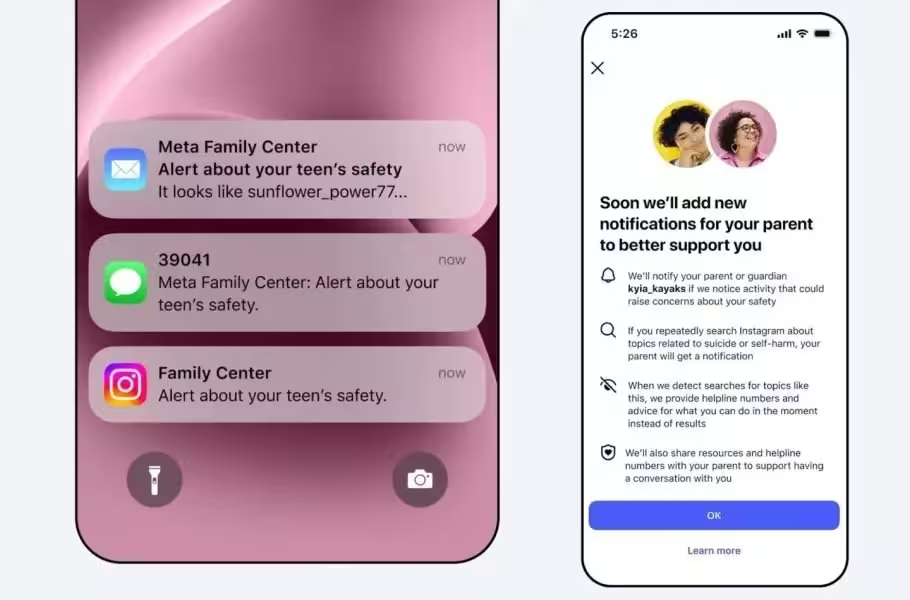

Meta sagt, genau das sei der Zweck. Das Unternehmen wird Eltern benachrichtigen, wenn jugendliche Konten innerhalb kurzer Zeit wiederholt Begriffe im Zusammenhang mit Suizid oder Selbstverletzung suchen. Die Funktion soll nächste Woche für Teenager-Profile in den Vereinigten Staaten, dem Vereinigten Königreich, Australien und Kanada eingeführt werden; eine breitere globale Ausweitung ist bis Ende des Jahres geplant.

Es gibt Vorbehalte. Dieses System funktioniert nur in Haushalten, die bereits die Aufsichtsfunktionen von Instagram aktiviert haben. Diese Funktion verlangt, dass diese Kontrollen aktiviert sind, bevor Alerts Betreuungspersonen erreichen können. Instagram blockiert bereits einige schädliche Suchergebnisse und leitet Nutzer zu Hilfsangeboten weiter, doch dies ist das erste Mal, dass die Plattform proaktiv Informationen an Eltern basierend auf dem Suchverhalten von Jugendlichen weitergibt.

Wie die Benachrichtigungen funktionieren

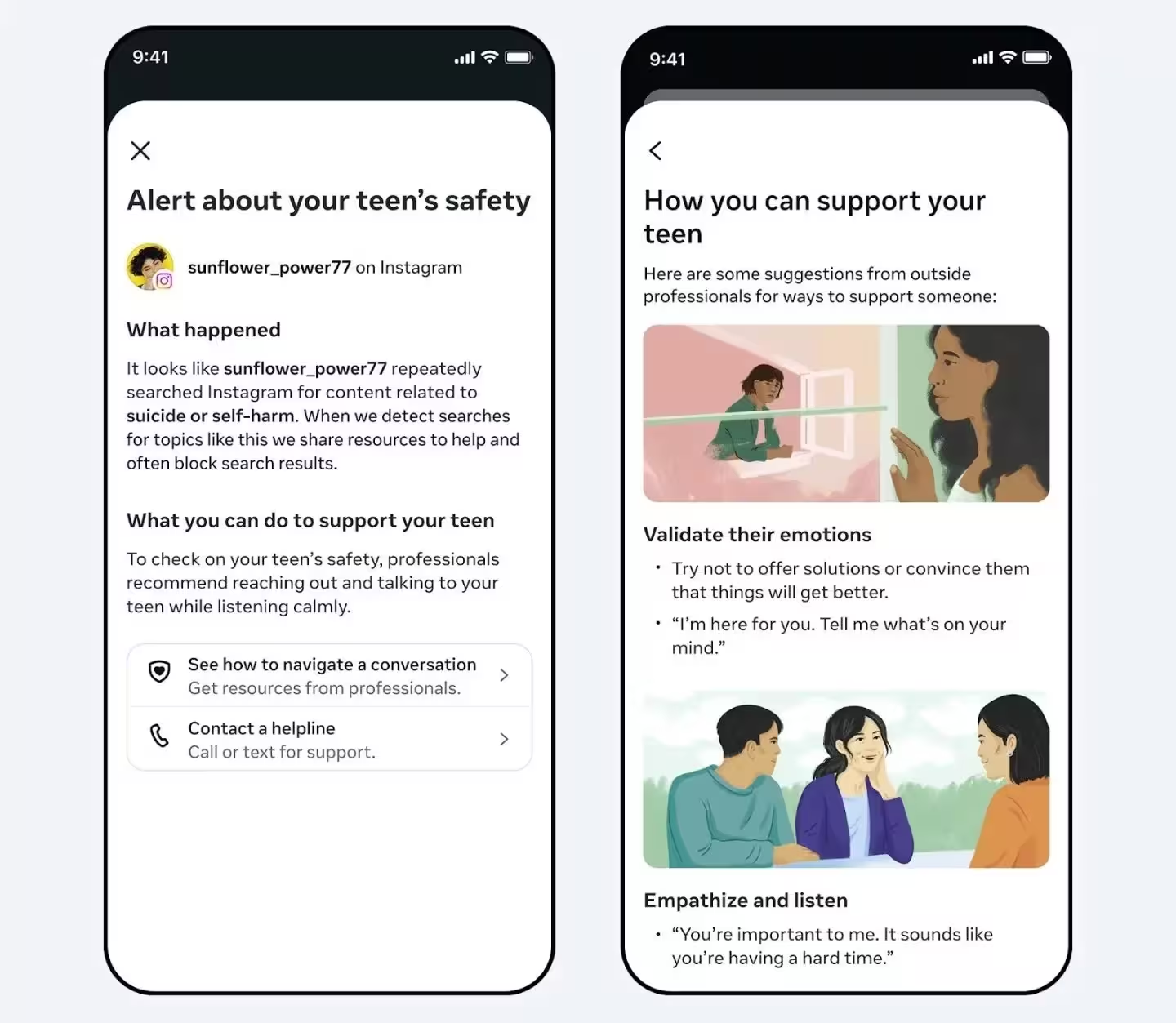

Meta erklärt, dass die Benachrichtigung die Kontaktmethode verwenden wird, die dem überwachenden Konto zugeordnet ist — Textnachrichten, E-Mail, WhatsApp oder In-App-Benachrichtigungen — abhängig davon, welche Informationen verfügbar sind. Jede Warnung wird von Hinweisen und Bildungsressourcen begleitet, die Familien helfen sollen, schwierige Gespräche zu beginnen und bei Bedarf professionelle Hilfe zu finden. Meta beschreibt das System als bewusst vorsichtig; es kann verdächtige Muster markieren, selbst wenn eine Gefahr nicht sicher ist, und stellt dabei Sicherheit vor Verschweigen.

Signalverarbeitung und technische Details

Technisch gesehen analysiert die Funktion Suchanfragen und erkennt Muster innerhalb eines kurzen Zeitfensters. Begriffe, die typischerweise mit Suizidgedanken oder selbstschädigendem Verhalten assoziiert werden, bilden Trigger für das System. Sobald die Schwelle für wiederholte oder verstärkte Suchanfragen überschritten ist, wird ein Signal in einen Benachrichtigungs-Workflow eingespeist, der die verknüpfte Aufsichtskontaktinformation nutzt.

Wichtig ist, dass diese Erkennung nach Angaben von Meta keine vollständige Gewissheit über eine akute Gefahr erzielt: Es handelt sich um eine Wahrscheinlichkeitsbewertung auf Basis von Suchmustern. Die Methode priorisiert Prävention und Früherkennung, nicht Diagnose. Solche Signale sind also Indikatoren, keine Beweise.

Kontaktwege für Eltern

Meta nennt mehrere mögliche Kontaktwege. Die Auswahl hängt von den Daten ab, die beim überwachenden Konto hinterlegt sind:

- SMS / Textnachricht

- WhatsApp-Nachricht

- In-App-Benachrichtigung innerhalb von Instagram

Die Nachricht enthält nicht nur die knappe Information, sondern wird laut Meta mit Ressourcen, Links zu Hilfsorganisationen und Ratschlägen für erste Gespräche ergänzt. Das Ziel ist, Eltern konkrete Schritte an die Hand zu geben: wie man eine ruhige Unterhaltung beginnt, wann man professionelle Hilfe in Anspruch nehmen sollte und wo lokale Notfallnummern zu finden sind.

Sicherheitsdesign und Nutzerschutz

Meta betont, das System sei so gestaltet, dass es Sicherheitsüberlegungen priorisiere. Dazu gehört, dass falsche Negative (also verpasste Warnungen) reduziert werden sollen, selbst wenn das bedeutet, mehr potenziell ungenaue Signale anzuzeigen. Die Absicht ist, lieber einen falschen Alarm zu riskieren, als ein mögliches Krisensignal zu übersehen.

Einschränkungen und Vorbehalte

Die Funktion hat Grenzen, die sowohl technisch als auch ethisch sind. Die wichtigste technische Einschränkung: Die Benachrichtigung funktioniert nur, wenn Eltern die Aufsichtsfunktionen aktiviert haben. Haushalte, die diese Kontrollen nicht nutzen, bleiben unberührt.

Auf ethischer Ebene warnen Kritiker vor mehreren Risiken:

- Unvorbereitete Eltern: Plötzliche nächtliche Warnungen können Betreuungspersonen erschrecken, die nicht auf eine Krise vorbereitet sind.

- Verlagerung der Verantwortung: Indem Plattformen Warnungen an Familien schicken, kann der Eindruck entstehen, die Plattform selbst löse damit ihre Verantwortung, gefährdende Inhalte und algorithmische Verstärkung wirksam zu reduzieren.

- Fehlalarme und Stigmatisierung: Fehlende Kontextinformationen können zu falsch interpretierten Situationen führen und Jugendliche unnötig stigmatisieren.

Reaktionen von Organisationen und Befürwortern

Nicht alle sind beruhigt. Andy Burrows, CEO der Molly Rose Foundation, warnt davor, dass plötzliche Alerts Betreuungspersonen in Panik versetzen können, die nicht auf eine Krise vorbereitet sind, und dass der Schritt das Risiko birgt, Verantwortung von der Plattform wegzuschieben. Die Stiftung — entstanden nach dem Suizid der 14-jährigen Molly Russell im Jahr 2017 — argumentiert, Instagram empfehle weiterhin Inhalte im Zusammenhang mit Depression und Selbstverletzung an junge Menschen. Ihrer Ansicht nach wäre eine Behebung der algorithmischen Verstärkung (Algorithmic Amplification) eine sinnvollere Lösung, als das Problem auf Familien abzuwälzen.

Argumente von Experten

Experten für digitale Kindersicherheit und psychische Gesundheit betonen die Balance zwischen Früherkennung und Vertraulichkeit. Sie sagen:

- Früherkennung kann Leben retten, insbesondere wenn sie zu rascher Intervention führt.

- Gleichzeitig sind Datenschutz, Einwilligung und die Autonomie junger Menschen wichtige Prinzipien.

- Plattformen müssen Verantwortung dafür übernehmen, welche Inhalte sie empfehlen und wie Algorithmen vulnerable Personen erreichen.

Was sich für Jugendliche praktisch ändert

Für Jugendliche bedeutet die Änderung: Suchanfragen, die zuvor auf einen weiterleitenden Hilfsbildschirm gelenkt wurden, fließen jetzt auch als Signale in einen Elternbenachrichtigungsstrom, wenn sich wiederholte Absichten vermuten lassen. Das ändert die Dynamik der Intervention:

- Für manche Jugendliche kann die Aussicht auf elterliche Benachrichtigung entlastend sein, wenn sie Unterstützung wünschen.

- Für andere kann es die Hemmschwelle erhöhen, sich online nach Hilfe umzusehen, aus Angst vor Konsequenzen oder Verlust der Privatsphäre.

Die Maßnahme kann also sowohl Schutz als auch Rückschritt sein — abhängig von familiärer Situation, kulturellem Kontext und dem Umgang mit psychischer Gesundheit im jeweiligen Umfeld.

Praktische Ratschläge für Eltern

Unabhängig von Kontroversen gibt es konkrete Schritte, die Eltern ergreifen können, um sich vorzubereiten und unterstützend zu handeln:

- Informieren: Aktivieren Sie die angebotenen Aufsichtsfunktionen bewusst und informieren Sie sich darüber, welche Signale welche Reaktionen auslösen.

- Vorbereiten: Legen Sie einen Plan fest, wie Sie reagieren würden — inklusive Notfallkontakte, Telefonnummern von Krisendiensten und lokalen Gesundheitsangeboten.

- Kommunizieren: Führen Sie offene, nicht wertende Gespräche mit Ihren Kindern über mentale Gesundheit und digitale Aktivitäten.

- Hilfe suchen: Scheuen Sie nicht davor zurück, professionelle Hilfe einzubeziehen, wenn eine Warnung auf ein ernstes Problem hindeutet.

- Wahrung der Privatsphäre: Respektieren Sie dennoch die Privatsphäre und Autonomie des Jugendlichen — zu viel Kontrolle kann Vertrauen untergraben.

Beispiel für ein Gesprächsstart

Ein möglicher, ruhiger Einstieg könnte lauten: "Mir ist eine Meldung aufgefallen, die mich beunruhigt. Mir ist wichtig, wie es dir geht. Möchtest du darüber sprechen oder sollen wir zusammen Unterstützung suchen?" Solche offene Formulierungen reduzieren Schuld- und Schamgefühle und öffnen den Raum für Dialog.

Datenschutz, Ethik und Regulierung

Die Einführung von Elternbenachrichtigungen berührt zahlreiche regulatorische und ethische Fragen:

- Datenschutz: Welche Daten werden ausgewertet, wie lange werden sie gespeichert und wer hat Zugang dazu?

- Einwilligung und Minderjährige: Wie werden die Rechte von Jugendlichen gegenüber dem Schutzinteresse der Eltern gewichtet?

- Haftung und Verantwortung: Inwieweit entbindet eine Benachrichtigung Plattformen von der Verantwortung, schädliche Inhalte zu minimieren?

Gesetzgeber in mehreren Ländern beobachten solche Funktionen genau. Regulierungsbehörden könnten zukünftig Auflagen zu Transparenz, Zweckbindung und Löschfristen erlassen. Plattformen sind zudem zunehmend angehalten, Audits ihrer Empfehlungsalgorithmen durchzuführen und unabhängige Prüfmechanismen zuzulassen.

Internationale Unterschiede

Die Ausrollung beginnt in Ländern mit relativ striktem Fokus auf Kindersicherheit und bestehenden Aufsichtstools. Unterschiedliche Datenschutzgesetze (z. B. GDPR in der EU vs. US-Recht) werden die globale Ausrollung und Anpassungen beeinflussen. Deshalb plant Meta eine gestaffelte Einführung und länderspezifische Anpassungen.

Technische und politische Empfehlungen

Experten und Organisationen empfehlen Plattformen, zusätzlich zu solchen Benachrichtigungen weitere Maßnahmen zu ergreifen:

- Reduktion algorithmischer Verstärkung schädlicher Inhalte durch gezielte Adjustierung von Empfehlungslogiken.

- Verbesserte Transparenz für Nutzer über die Funktionsweise von Empfehlungen und Suchergebnissen.

- Partnerschaften mit Gesundheitsorganisationen und Notfallangeboten zur schnellen Verlinkung von Ressourcen.

- Regelmäßige Evaluierung der Wirksamkeit von Alert-Systemen durch unabhängige Forschung und Audits.

Wird eine Benachrichtigung Leben retten?

Das ist die zentrale Frage. Ein Alert kann in manchen Fällen eine lebensrettende Frühwarnung sein, die zu rechtzeitiger Intervention führt. Zugleich besteht die Gefahr, dass die Maßnahme Debatten über Verantwortung verschärft: Wer trägt Verantwortung für online erzeugtes Leid — die Plattform, die Eltern oder die Gesellschaft und Regulierer?

Die Antwort wird sich vermutlich nicht als monolithisch herausstellen. Unterschiedliche Familien, Regionen und Einzelfälle werden unterschiedliche Ergebnisse zeigen. Deshalb ist es wichtig, die Maßnahme kontinuierlich zu begleiten, Daten auszuwerten und Anpassungen vorzunehmen.

Fazit

Die neue Funktion von Meta, Eltern über wiederholte Suchanfragen Jugendlicher zu Selbstverletzung oder Suizid zu informieren, ist sowohl ein proaktiver Schutzmechanismus als auch ein politisch-ethischer Prüfstein. Sie zielt darauf ab, Frühwarnsignale an jene zu senden, die kurzfristig intervenieren können, stellt aber gleichzeitig Anforderungen an Plattformverantwortung, Datenschutz und die Bereitschaft von Familien, sensibel und unterstützend zu reagieren.

Ob ein Alarm letztlich ein Kind in einer akuten Krise rettet oder eine größere Debatte über Verantwortlichkeiten auslöst, bleibt offen. Das öffentliche, regulatorische und wissenschaftliche Monitoring dieser Funktion wird entscheidend sein, um zu bewerten, ob solche Alerts tatsächlich den gewünschten Nutzen bringen — und wie sie verbessert werden müssen, um sowohl wirksam als auch ethisch vertretbar zu sein.

Quelle: smarti

Kommentar hinterlassen