10 Minuten

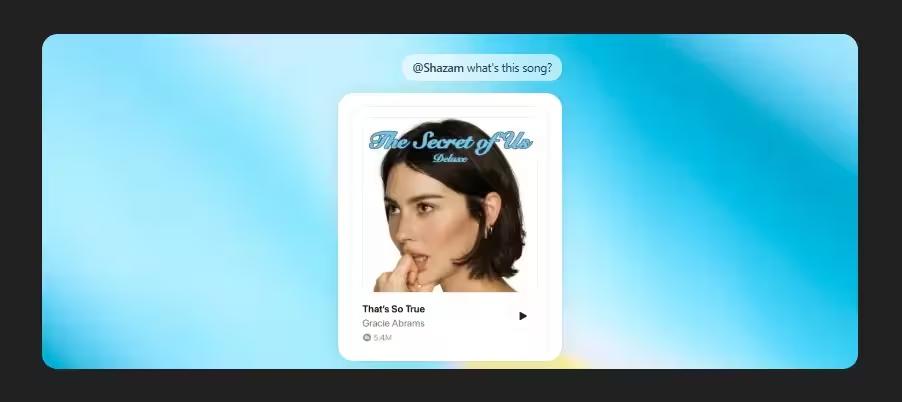

Sie sitzen in einem Café. Ein Lied klingt aus den Lautsprechern — eingängig, unbekannt und kaum zu überhören. Instinktiv greifen Sie nach Ihrem Telefon, um Shazam zu starten. Doch inzwischen gibt es eine neue Möglichkeit: Möglicherweise müssen Sie ChatGPT dafür gar nicht mehr verlassen.

Apple und OpenAI haben still und leise eines der beliebtesten Tools zur Musikentdeckung direkt in die ChatGPT-Erfahrung integriert. Das Ergebnis ist schlicht, aber wirkungsvoll. Anstatt zwischen verschiedenen Apps zu wechseln, können Nutzer Songs jetzt direkt aus der Chatoberfläche heraus identifizieren.

Geben Sie etwa den Prompt ' @Shazam ' ein oder fragen Sie ChatGPT, welches Lied gerade läuft, und die App zeigt einen Mikrofonbutton an. Tippen Sie darauf, lassen Sie den Ton kurz abspielen, und die bekannte Shazam-Erkennungsengine übernimmt. Innerhalb weniger Sekunden liefert ChatGPT den Titel des Tracks samt einer Vorschau — dargestellt als schlanke Karten, die optisch an Apple Music erinnern.

Im Kern handelt es sich um dieselbe Audio-Fingerprinting-Technologie, die Shazam berühmt gemacht hat. Der Unterschied liegt darin, wo diese Technologie zur Verfügung steht. Anstatt ein separates Tool zu sein, das man eilig vor dem Ende des Refrains startet, ist Shazam nun in die Konversationsschicht eines KI-Assistenten eingebettet.

Musikentdeckung ohne den Chat zu verlassen

Der praktischste Aspekt dieser Integration ist vielleicht ihre Reichweite. Sie benötigen kein iPhone, keinen Mac und kein anderes Apple-Gerät, um die Funktion zu nutzen. Das Feature läuft innerhalb von ChatGPT plattformübergreifend — inklusive Android, iOS und Web. Mit anderen Worten: Die Musikerkennung findet in der KI-Umgebung statt und nicht ausschließlich im Apple-Hardware-Ökosystem.

Apple-Nutzer erhalten dennoch einen kleinen Bonus. Ist die eigenständige Shazam-App bereits auf dem Telefon installiert, lassen sich über ChatGPT erkannte Songs direkt in die Shazam-Bibliothek speichern. So bleiben Fundstücke an einem dedizierten Ort organisiert, statt in langen Chat-Verläufen der KI unterzugehen.

Und damit endet die Erfahrung nicht bei der reinen Identifikation. ChatGPT unterstützt bereits Integrationen mit Apple Music und Spotify. Das bedeutet: Der gerade identifizierte Track kann unmittelbar als Ausgangspunkt für eine neue Playlist dienen. Einen Moment fragen Sie die KI, welches Lied läuft; im nächsten Moment kuratieren Sie eine Playlist rund um dieses Stück.

Es ist ein kleiner Workflow-Wechsel, doch er deutet etwas Größeres an: KI-Assistenten entwickeln sich langsam zu zentralen Hubs für alltägliche digitale Aufgaben. Musikentdeckung, Empfehlungen und Playlist-Erstellung — ehemals auf mehrere Apps verteilte Arbeitsschritte — verschmelzen zunehmend zu einer einzigen, konversationellen Benutzeroberfläche.

Wie die Integration technisch funktioniert

Die Grundlage der Erkennung ist Audio-Fingerprinting, eine Methode, die akustische Eigenschaften eines Songs in ein kompaktes, vergleichbares Muster überführt. Diese Technologie analysiert Frequenzmuster, Lautstärkepeaks und zeitliche Beziehungen zwischen Signalsegmenten, um ein einzigartiges Muster zu erzeugen, das mit einer Datenbank bekannter Songs abgeglichen werden kann.

Audio-Fingerprinting und Matching

Audio-Fingerprinting besteht aus mehreren Schritten:

- Vorverarbeitung: Das Audiosignal wird normalisiert und in Frequenzbereiche zerlegt (z. B. mittels Fourier-Transformation).

- Merkmalsextraktion: Charakteristische Punkte wie lokale Maxima in Zeit-Frequenz-Darstellungen werden identifiziert.

- Fingerprint-Erzeugung: Aus diesen Punkten wird ein kompaktes, nicht rekonstruierbares Muster erzeugt, das als Fingerprint dient.

- Abgleich: Der Fingerprint wird mit einer großen Datenbank verglichen, um Übereinstimmungen zu finden.

Der Vorteil dieses Verfahrens liegt in Robustheit und Effizienz: Selbst bei Hintergrundgeräuschen oder Teilaufnahmen lassen sich Songs zuverlässig identifizieren. Im Zusammenspiel mit ChatGPT sorgt die Integration dafür, dass der Fingerprinting-Dienst nahtlos auf Zuruf gestartet wird und die Ergebnisse in die Chat-Oberfläche eingebettet zurückgegeben werden.

Wo die Erkennung ausgeführt wird

Ein wichtiger Aspekt für Nutzer ist, wo die Analyse stattfindet: lokal auf dem Gerät, auf Servern von OpenAI, auf Apples Servern oder auf einer Kombination davon. Konkrete Architekturdetails können variieren, doch typischerweise umfasst der Ablauf:

- Erfassung: Das Mikrofon nimmt einige Sekunden Audio auf.

- Vorverarbeitung lokal: Grundlegende Filterung und Kompression, um Datenvolumen zu reduzieren.

- Übertragung und Matching: Ein kompakter Fingerprint oder komprimierte Audiodaten werden an den Erkennungsdienst geschickt.

- Rückgabe: Identifikationsergebnis und Metadaten (Titel, Künstler, Album) werden in ChatGPT angezeigt.

Für Entwickler und technisch Interessierte heißt das: Die Integration muss Latenz, Datentransfer und Datenschutz gegeneinander abwägen, um ein flüssiges Nutzererlebnis zu gewährleisten.

Plattformunterstützung und Kompatibilität

Ein Pluspunkt der Integration ist ihre Plattformunabhängigkeit. Die Musikerkennung in ChatGPT ist so konzipiert, dass sie auf verschiedenen Betriebssystemen und Geräten funktioniert:

- Webbrowser: Direkt im Browser-Tab, ohne zusätzliche App-Installation.

- Android-Geräte: Integration in der ChatGPT-App für Android.

- iOS-Geräte: Integration in der ChatGPT-App für iPhone und iPad, mit zusätzlicher Verknüpfung zur Shazam-App, falls installiert.

Diese plattformübergreifende Umsetzung ist wichtig, um die Hürde für Nutzer gering zu halten: Musikerkennung soll schnell und intuitiv funktionieren — unabhängig davon, welches Gerät zur Hand ist.

Integration mit Streaming-Diensten

Ein weiterer praktischer Aspekt ist die Verbindung zu Streaming-Diensten wie Apple Music und Spotify. Nachdem ein Song identifiziert wurde, bieten sich mehrere Optionen:

- Vorschau anhören: Kurze Hörprobe direkt in der Chatkarte.

- Link zum Streamingdienst: Direkte Schaltflächen, die den Track in Apple Music oder Spotify öffnen.

- Playlist-Erstellung: Der erkannte Song kann als Basis für neue Playlists dienen oder zu bestehenden Playlists hinzugefügt werden.

Für Nutzer bedeutet das weniger Arbeit: Sie entdecken Musik, merken sich Titel und bauen im Anschluss bequem ihre Musiksammlung aus.

Einrichtung, Nutzung und Best Practices

Die Einrichtung ist bewusst einfach gehalten: Das Shazam-Tool ist nicht automatisch aktiv, lässt sich aber in wenigen Schritten verbinden. Typische Schritte sind:

- ChatGPT-App öffnen und den Bereich 'Apps' oder 'Tools' aufrufen.

- Shazam in der Liste der verfügbaren Tools finden und auswählen.

- Mit dem Konto verbinden: Bei Bedarf werden Berechtigungen bestätigt und ggf. Shazam- oder Apple-ID-Informationen verknüpft.

- Die Erkennung direkt im Chat aufrufen: Prompt verwenden oder das Mikrofon-Symbol betätigen.

Tipps für optimale Erkennung:

- Halten Sie das Mikrofon in Richtung der Klangquelle und reduzieren Sie Hintergrundlärm.

- Lassen Sie genügend Sekunden Audio laufen — bei kurzen Jingles sind 5–7 Sekunden oft ausreichend, bei komplexerem Audio kann es etwas länger dauern.

- Wenn Sie sensible Umgebungen haben, prüfen Sie die Datenschutzeinstellungen, bevor Sie Audiodaten senden.

Datenschutz, Sicherheit und rechtliche Aspekte

Bei jeder Funktion, die Audio aufnimmt und an einen Dienst überträgt, spielt Datenschutz eine zentrale Rolle. Nutzer sollten sich über folgende Punkte im Klaren sein:

- Welche Daten werden erfasst? In der Regel werden nur kurze Audioausschnitte oder daraus abgeleitete Fingerprints übertragen, nicht vollständige Aufnahmen.

- Wo werden die Daten verarbeitet? Die Verarbeitung kann auf Servern von OpenAI, Apple oder dritten Dienstleistern stattfinden, abhängig von der Implementierung.

- Wie lange werden Daten gespeichert? Viele Dienste speichern nur temporäre Metadaten für Abgleichzwecke, während andere ggf. längere Logs für Qualitäts- und Sicherheitsanalysen behalten.

Für datenschutzbewusste Anwender empfiehlt sich, die jeweiligen Datenschutzrichtlinien von OpenAI, Apple und Shazam zu prüfen. Außerdem sollte darauf geachtet werden, welche Berechtigungen beim ersten Anbinden des Tools erteilt werden.

Transparenz und Kontrolle

Wichtig ist, dass Nutzer Kontrolle über ihre Daten behalten. Praktische Kontrollen umfassen:

- Opt-in bei der Aktivierung des Tools statt automatischer Aktivierung.

- Möglichkeiten zum Löschen der erkannten Songs oder zu exportieren/übertragen in persönliche Bibliotheken.

- Einsehbare Logs: Transparenz über die zuletzt erkannten Songs und verwendete Metadaten.

Vorteile, Grenzen und mögliche Probleme

Die Integration bringt viele Vorteile, aber auch einige Grenzen und potenzielle Probleme:

Vorteile

- Komfort: Direkte Musikerkennung im Chat spart Zeit und reduziert App-Wechsel.

- Integration: Nahtlose Weiterverarbeitung der Ergebnisse durch Playlist-Erstellung oder Verknüpfung mit Streamingdiensten.

- Plattformübergreifend: Funktioniert auf verschiedenen Geräten und Betriebssystemen.

Begrenzungen

- Erkennungsfehler: Bei Live-Auftritten, Remixes oder sehr ähnlichen Songs können Fehlzuordnungen vorkommen.

- Umgebungslärm: Starke Störgeräusche können die Genauigkeit beeinträchtigen.

- Datenschutzbedenken: Nicht alle Nutzer möchten Audioaufnahmen an externe Dienste senden.

Darüber hinaus kann es Unterschiede zwischen einer reinen Shazam-App auf dem Gerät und der Chat-Integration geben, beispielsweise in Bezug auf verfügbare Metadaten, Tiefe der Verknüpfung mit Nutzerbibliotheken oder die Art und Weise, wie Vorschauen angezeigt werden.

Ausblick: Was bedeutet das für die Zukunft der Musikentdeckung?

Diese Integration ist ein Beispiel für einen allgemeinen Trend: KI-basierte Assistenten übernehmen zunehmend Aufgaben, die früher mehrere spezialisierte Apps erforderten. Für die Musikbranche und Nutzer bedeutet das:

- Mehr Konvergenz: Musikentdeckung, sozialer Austausch und Streaming-Funktionen wachsen in einem Interface zusammen.

- Personalisierung: KI kann gefundene Songs sofort in personalisierte Empfehlungen und Playlists einfließen lassen.

- Neue Nutzungsszenarien: Von Live-Shazam-Features in Social-Media-Chats bis hin zu automatisierter Playlist-Erstellung während Events.

Für Entwickler und Anbieter ist die Herausforderung, ein Gleichgewicht zwischen Komfort, Genauigkeit und Datenschutz zu finden. Für Nutzer bietet sich die Chance, Musik schneller zu entdecken und unmittelbarer zu konsumieren — mit weniger Reibung zwischen Entdeckung und Wiedergabe.

Fazit

Die Einbettung von Shazam in ChatGPT verändert den Workflow beim Erkennen von Musik nicht dramatisch, wohl aber spürbar. Es ist ein Schritt hin zu einer vernetzten, konversationellen Nutzererfahrung, in der ein KI-Assistent als Dreh- und Angelpunkt für alltägliche digitale Aufgaben dient. Ob Sie ein begeisterter Musikentdecker, ein Gelegenheitshörer oder ein Power-User sind — die Möglichkeit, Songs direkt im Chat zu identifizieren und sofort weiterzuverarbeiten, macht den Prozess schneller, einfacher und in vielen Fällen auch kreativer.

Die weltweite Ausrollung hat bereits begonnen: Egal ob Smartphone, Tablet oder Browser-Tab — der vertraute Moment "Welches Lied ist das?" ist nun etwas schneller und wesentlich dialogorientierter geworden.

Kommentar hinterlassen