5 Minuten

Fragen Sie einen KI-Chatbot nach einem Aktienkurs, einem Gerichtstermin oder dem Namen eines Firmenvorstands, und die Antwort kann mit äußerster Selbstsicherheit kommen. Das ist der beunruhigende Teil. Der Satz kann glatt formuliert sein, der Ton sicher wirken, und die Fakten können trotzdem falsch sein.

Eine neue Zuverlässigkeitsanalyse von Legal Guardian Digital, einer auf Anwaltskanzleien spezialisierten SEO-Firma, hinterlegt mit Zahlen ein Problem, das viele Nutzer bereits kennen: Einige beliebte KI-Chatbots halluzinieren deutlich häufiger als andere. Da inzwischen etwa ein Viertel der amerikanischen Beschäftigten regelmäßig KI-Tools nutzt, ist der Unterschied zwischen einem hilfreichen Assistenten und einer überzeugenden Quelle von Fehlinformationen keine Kleinigkeit.

Der unbequeme Teil: Selbstsicherheit ist nicht gleich Genauigkeit

Große Sprachmodelle denken nicht wie Menschen. Sie werden trainiert, wahrscheinliche Wörter und Wendungen anhand von Mustern in enormen Textmengen vorherzusagen. Wenn das System ausreichend Kontext hat, kann das schnelle, nützliche Antworten erzeugen. Fehlt dieser Kontext, kann das Modell dennoch eine Antwort erzeugen, die plausibel klingt, weil die Wörter statistisch zusammenpassen.

Das ist in der Regel gemeint, wenn Menschen sagen, ein KI-Chatbot halluziniere. Er träumt nicht vor sich hin. Er lügt auch nicht im menschlichen Sinn. Er liefert eine Antwort ohne verlässliche faktische Grundlage, weshalb Namen, Daten, juristische Verweise, medizinische Details, finanzielle Zahlen und aktuelle Nachrichten weiterhin menschliche Überprüfung benötigen.

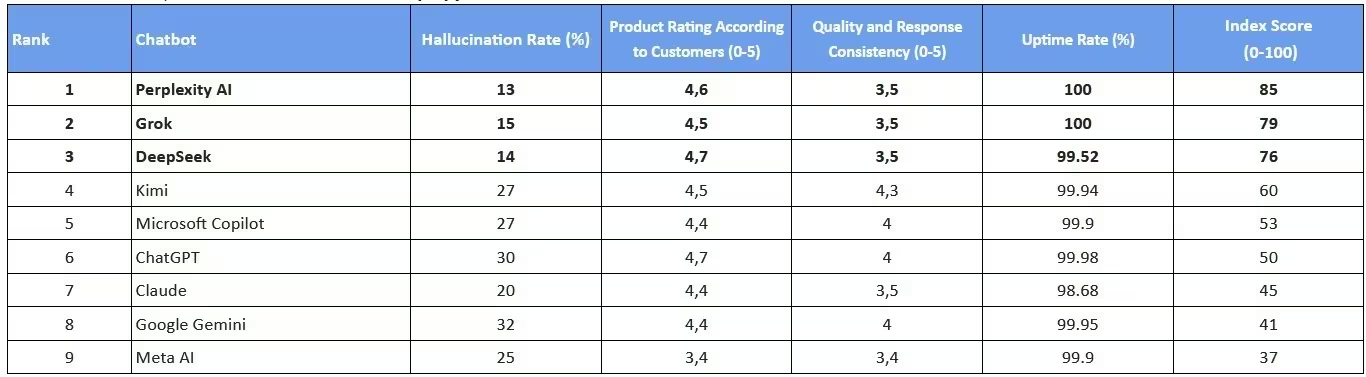

Die Studie verglich mehrere bekannte KI-Modelle anhand von Halluzinationsraten, Kundenzufriedenheit, Antwortqualität und Verfügbarkeit. Diese Faktoren wurden zu einem Indexwert von 0 bis 100 kombiniert und geben so einen breiteren Überblick darüber, welche Chatbots im Alltag am zuverlässigsten sind.

Google Gemini wies in der Gruppe die höchste Halluzinationsrate auf und lieferte Berichten zufolge in 32 % der Antworten ungenaue Informationen. Diese Zahl ist besonders bemerkenswert vor dem Hintergrund von Berichten, wonach Apple Google mindestens 1 Milliarde Dollar pro Jahr zahlt, um ein maßgeschneidertes Gemini-Modell mit 1,2 Billionen Parametern für ein Siri-Upgrade zu nutzen, das mit iOS 27 erwartet wird.

ChatGPT folgte dicht dahinter, mit Halluzinationen in etwa drei von zehn Antworten. Vereinfacht gesagt, wenn sich diese Zahlen halten, wäre ChatGPT in diesem Test etwa doppelt so wahrscheinlich wie DeepSeek, eine falsche Antwort zu geben. Dieser Vergleich wird wohl Aufmerksamkeit erregen, nicht zuletzt weil DeepSeek zu einem Bruchteil der Trainingskosten entwickelt wurde, die mit führenden US-Modellen verbunden sind.

Perplexity AI schnitt bei der Halluzinationsrate am besten ab: Falsche Antworten erreichten Nutzerinnen und Nutzer in 13 % der Fälle. DeepSeek lag knapp dahinter mit 14 %, während Elon Musks Grok bei 15 % lag. Für Anwender, die KI für Recherchen, Zusammenfassungen oder schnelle Faktenchecks nutzen, sind diese Unterschiede bedeutsam.

Online-Verfügbarkeit bleibt entscheidend

Genauigkeit ist nur ein Teil der Geschichte. Ein Chatbot kann auf dem Papier brillant und zugleich nutzlos sein, wenn er nicht verfügbar ist, wenn ihn jemand braucht. Bei der Verfügbarkeit blieben Perplexity AI und Grok die einzigen beiden Dienste in der Umfrage, die während des gesamten Testzeitraums erreichbar waren.

ChatGPT und Gemini folgten knapp dahinter mit Verfügbarkeitsraten von 99,98 % bzw. 99,95 %. Selbst Claude, das in der Studie die niedrigste Verfügbarkeit aufwies, blieb mit 99,68 % sehr zuverlässig. Praktisch betrachtet waren die meisten dieser Werkzeuge nahezu durchgängig online, doch selbst kleine Unterschiede können für Unternehmen, die auf KI-Workflows angewiesen sind, relevant sein.

Die Kundenzufriedenheit erzählte eine andere Geschichte. DeepSeek und ChatGPT erhielten jeweils die höchste Kundenzufriedenheitsbewertung von 4,7 von 5. Perplexity AI folgte mit 4,6. Meta AI landete mit 3,4 auf dem letzten Platz, während mehrere andere Modelle um etwa 4,4 lagen.

Bei Konsistenz und Qualität der Antworten führte Kimi AI das Feld mit 4,3 von 5 an. ChatGPT, Microsoft Copilot und Gemini lagen gleichauf bei 4,0. Meta AI belegte erneut den letzten Platz mit 3,4, was darauf hindeutet, dass die schwächere Gesamtwertung nicht durch eine einzelne schwache Kategorie verursacht wurde.

Wurden alle Faktoren kombiniert, belegte Perplexity AI mit einem Indexwert von 85 den ersten Platz. Grok landete mit 79 auf dem zweiten Platz, gefolgt von DeepSeek. ChatGPT belegte mit 50 den sechsten Platz, während Gemini mit 41 den achten Platz einnahm. Meta AI lag mit 37 auf dem letzten Platz.

Die größere Lehre ist nicht, dass einem Chatbot blind vertraut und ein anderer für immer gemieden werden sollte. KI-Tools ändern sich schnell. Modelle werden aktualisiert, Schutzmechanismen verschieben sich, und die Leistung kann sich nahezu über Nacht verbessern. Dennoch ist eine solche Rangliste eine nützliche Erinnerung: Der bekannteste Chatbot ist nicht immer der zuverlässigste, und die glätteste Antwort ist nicht zwangsläufig die richtige.

Für alle, die KI bei der Arbeit einsetzen, ist der sicherste Ansatz schlicht: Behandeln Sie Chatbots als Beschleuniger, nicht als endgültige Autorität. Lassen Sie sie entwerfen, organisieren, zusammenfassen und Ideen entwickeln. Wenn die Antwort jedoch Geld, Gesundheit, Recht, Identität oder eine Entscheidung mit realen Konsequenzen betrifft, prüfen Sie die Fakten, bevor Sie handeln.

Kommentar hinterlassen