3 Minuten

Huawei Cloud kündigte auf der China International Big Data Industry Expo in Guiyang einen deutlichen Ausbau seiner KI-Rechenkapazität an. CEO Zhang Ping'an berichtete, dass die gesamten Rechenressourcen des Unternehmens im Jahresvergleich um 250 % gewachsen seien und dass die Zahl der Ascend AI Cloud-Kunden von 321 auf 1.714 gestiegen ist. Die Expansion signalisiert Huaweis beschleunigte Investitionen in KI-Infrastruktur, um der steigenden Nachfrage nach Modelltraining, großskaliger Inferenz und unternehmensweiten KI-Anwendungen gerecht zu werden.

Network Architecture and Supernodes

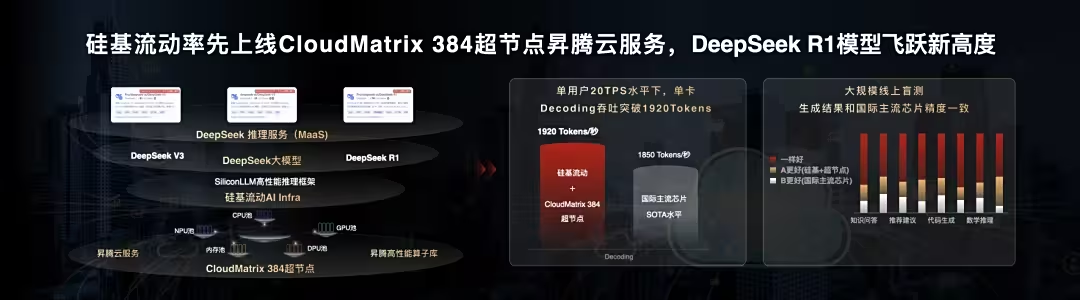

CloudMatrix 384 and a nationwide cluster

Huawei baut eine sogenannte „Schwarzerde der Rechenleistung“ über mehrere Hubs — Gui'an, Ulanqab, Horqin und Wuhu — aus. Der Standort Gui'an beherbergt den CloudMatrix 384-Supernode, der 384 Ascend-NPUs mit 192 Kunpeng-CPUs integriert. Huawei gibt an, dass ein einzelner CloudMatrix 384 rund 300 PFlops Spitzenleistung liefern und mehr als 1.300 großskalige Modelle gleichzeitig trainieren kann. Mit 432 online geschalteten Supernodes bildet das Netzwerk ein etwa 160.000-Karten großes KI-Cluster, das seit über zwei Jahren stabil betrieben wird.

Product Features

Die Plattform von Huawei kombiniert hochdichte Ascend-NPUs, Kunpeng-CPUs, optische Netzwerke und optimiertes Energiemanagement, um Platz- und Energieeffizienz zu erhöhen. Wichtige Merkmale sind:

- NPU-Beschleunigung mit hoher Durchsatzrate für Training und Inferenz

- Skalierbare Supernodes für paralleles Modelltraining

- Integrierte Netzwerk- und optische Verbindungen für latenzarme Kommunikation

- Energie- und rackbezogene Leistungsoptimierung zur Reduzierung der TCO

Comparisons and Market Position

Während globale Hyperscaler wie AWS, Microsoft Azure und Google Cloud viele internationale Märkte dominieren, schließt Huawei Cloud die Lücke in der KI-Infrastruktur im Inland und richtet sich an ausgewählte internationale Kunden. Die Einführung des Wuhu-Supernodes im April unterstreicht die Unterstützung für globale Workloads und Chinas East-West Computing-Initiative, die Rechenaufgaben regional neu verteilt, um Latenz und Kosten zu optimieren.

Advantages and Use Cases

Huawei hebt Finanzdienstleistungen als frühen Anwender hervor: Den Angaben zufolge unterstützen die Hubs in Gui'an und Ulanqab mehr als 1.000 KI-gesteuerte Finanzanwendungen pro Tag. Weitere Anwendungsfälle sind großskaliges Modelltraining, generative KI-Workloads, Empfehlungssysteme und standortübergreifende Unternehmensbereitstellungen.

Market Relevance and Strategic Impact

Diese Expansion stärkt Huaweis Bestreben, ein bedeutender Anbieter von KI-Infrastruktur zu werden. Durch die Kombination von Hardware, Netzwerk, optischer Kommunikation und Energiemanagement will Huawei ein wettbewerbsfähiges Leistungs-pro-Watt bieten und den Anforderungen von Unternehmen nach höherem Durchsatz und geringerer Latenz gerecht werden.

Entfernen, ersetzen oder ändern Sie keines der Originalbilder aus dem Quellinhalt – behalten Sie alle Bildplatzierungen, Bildunterschriften und Formate unverändert bei.

Conclusion

Das 250%-ige Wachstum der Rechenkapazität von Huawei Cloud, das großskalige, von Ascend betriebene Cluster und der Fokus auf Effizienz positionieren das Unternehmen als aufstrebende Alternative für KI-Infrastruktur – insbesondere in China und für Kunden, die regionenoptimierte Rechenressourcen im Rahmen der East-West Computing-Strategie suchen.

Quelle: gizmochina

Kommentar hinterlassen