5 Minuten

Gedanken in Sprache übersetzen

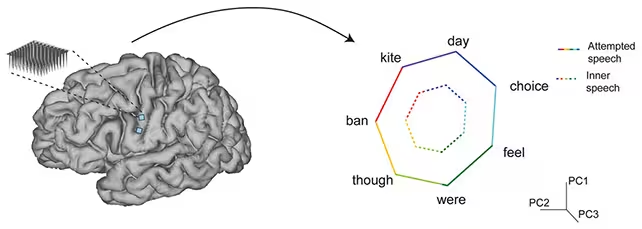

Forscher an mehreren Institutionen in den USA haben einen Inner-Speech-Decoder entwickelt — eine Gehirn‑Computer‑Schnittstelle (BCI), die vorgestellte Worte in Text oder hörbare Sprache übersetzt. In einem kleinen klinischen Test mit vier Freiwilligen mit schwerer Lähmung erreichte das System in Spitzenphasen eine Genauigkeit von 74 Prozent bei der Umwandlung innerer Sprache in hörbare Ausgabe. Veröffentlichten Daten (Kunz et al., Cell, 2025) und Kommentare von Neurowissenschaftlern der Stanford University zufolge rückt dieser Ansatz BCIs näher an die Dekodierung von Gedanken an ihrer Quelle, statt sich allein auf Signale stützen zu müssen, die bei dem Versuch, physisch zu sprechen, entstehen.

Wissenschaftlicher Hintergrund und Technologie

Der Decoder verwendet ein neuronales Implantat, um elektrische Aktivität des motorischen Kortex aufzuzeichnen — jener Hirnregion, die an Planung und Ausführung von Bewegungen beteiligt ist, einschließlich der für das Sprechen nötigen Bewegungen. Anstatt auf motorische Befehle zu warten, die die Muskeln erreichen, erkennt das Implantat neuronale Muster, die mit Phonemen, den grundlegenden Lauten der Sprache, verknüpft sind. Maschinelle Lernmodelle werden anschließend trainiert, diese Muster den Phonemen zuzuordnen und sie zu Wörtern und Sätzen zusammenzusetzen.

Dieser Wechsel von auf Versuch‑zu‑sprechen basierten BCIs hin zur Dekodierung innerer Sprache behebt eine zentrale Einschränkung für Menschen mit Locked‑in‑Syndrom oder schweren motorischen Beeinträchtigungen: Sie können möglicherweise keine Muskelversuche zum Sprechen erzeugen, wohl aber mentale Repräsentationen von Wörtern. Wie der Neurowissenschaftler Benyamin Meschede‑Krasa von Stanford anmerkt: "Wenn man nur an Sprache denken muss, anstatt tatsächlich zu versuchen zu sprechen, ist das für Menschen potenziell einfacher und schneller."

Versuchsdetails und zentrale Ergebnisse

In der berichteten Studie stellten sich vier Teilnehmer mit tiefgreifender Lähmung vor, bestimmte Worte und Phrasen zu sprechen, während implantierte Elektroden die Aktivität des motorischen Kortex abtasteten. Maschinelle Lernalgorithmen identifizierten statistische Zusammenhänge zwischen neuronalen Mustern und Spracheinheiten. Die Forschenden fanden überlappende, aber unterscheidbare Aktivität zwischen versuchtem Sprechen und reiner innerer Sprache; die Signale der inneren Sprache erschienen laut dem Stanford‑Neurowissenschaftler Frank Willett wie eine "kleinere" Version der Muster beim Versuch zu sprechen.

Mit probabilistischen Sprachmodellen, die gewichten, welche Phoneme und Wörter typischerweise gemeinsam auftreten, zeigte das System das Potenzial, einen Wortschatz von bis zu 125.000 Wörtern allein aus innerer Sprache zu erkennen. Die Spitzenleistung beim Dekodieren erreichte in einigen Bedingungen 74 Prozent, obwohl die durchschnittliche Genauigkeit über die Versuche hinweg oft niedriger lag. Die Studie testete außerdem eine Datenschutz‑Sicherheitsmaßnahme: Nutzer riefen mental ein spezifisches "Passwort" auf, um das Dekodieren zu aktivieren oder zu deaktivieren; dies erreichte in der experimentellen Aufgabe eine Zuverlässigkeit von 98 Prozent.

Einschränkungen, Datenschutz und klinische Aussichten

Wichtige Herausforderungen bleiben bestehen. Die Fallzahl war klein (vier Freiwillige) und die Leistungsfähigkeit variierte je nach Teilnehmer und Aufzeichnungsqualität. Die Genauigkeit reichte nicht an die Gesprächsflüssigkeit in Echtzeit heran, und die Technologie erfordert derzeit invasive Implantate sowie eine personalisierte Kalibrierung der maschinellen Lernmodelle. Es bestehen zudem ethische und datenschutzbezogene Bedenken: Ein Gerät, das innere Sprache dekodiert, könnte unbeabsichtigt private Gedanken aufzeichnen. Vorgeschlagene Schutzmaßnahmen umfassen explizite mentale Start/Stopp‑Signale, Authentifizierungsphrasen und On‑Device‑Kontrollen, um kontinuierliches Logging zu verhindern.

Die Forschenden sind optimistisch, dass Fortschritte bei Sensorarrays, breiterer kortikaler Kartierung und verbesserten Dekodieralgorithmen die Genauigkeit erhöhen und Modelle schneller personalisieren können als frühere BCI‑Entwicklungen. Verwandte Studien zu Jahresbeginn demonstrierten bereits die zeitnahe, personen‑spezifische Dekodierung von Gedanken, was den beschleunigten Fortschritt in der neuralen Dekodierung und bei Sprach‑BCIs unterstreicht.

Expertinneneinschätzung

Dr. Aisha Patel, Neuroingenieurin und klinische BCI‑Forscherin, kommentiert: "Diese Arbeit stellt einen wichtigen Proof of Principle dar. Die Kombination aus hochauflösenden neuronalen Aufzeichnungen und sprachsensitivem maschinellen Lernen ist vielversprechend. Um jedoch von Laborvorführungen zu einem alltäglichen klinischen Einsatz zu gelangen, benötigen wir größere Studien, robuste Datenschutzvorkehrungen und Schnittstellen, die an die einzigartige neuronale Signatur jeder Person lernen und sich anpassen können."

Fazit

Der neue Inner‑Speech‑Decoder markiert einen bedeutenden Schritt hin zu BCIs, die natürliche Kommunikation für Menschen mit schweren Sprech‑ und Motorikstörungen wiederherstellen können. Obwohl die Spitzenleistungen in frühen Tests ermutigend sind, sind breitere Validierung, verbesserte Implantattechnologie und strenge Datenschutzmaßnahmen essenziell, bevor Gedanke‑zu‑Sprache‑Systeme sichere und verlässliche klinische Werkzeuge werden können. Weitergehende interdisziplinäre Arbeit in den Feldern Neurowissenschaften, maschinelles Lernen und Ethik wird entscheidend dafür sein, wie schnell und verantwortungsvoll diese Fähigkeit Patienten erreicht.

Quelle: sciencealert

Kommentar hinterlassen