9 Minuten

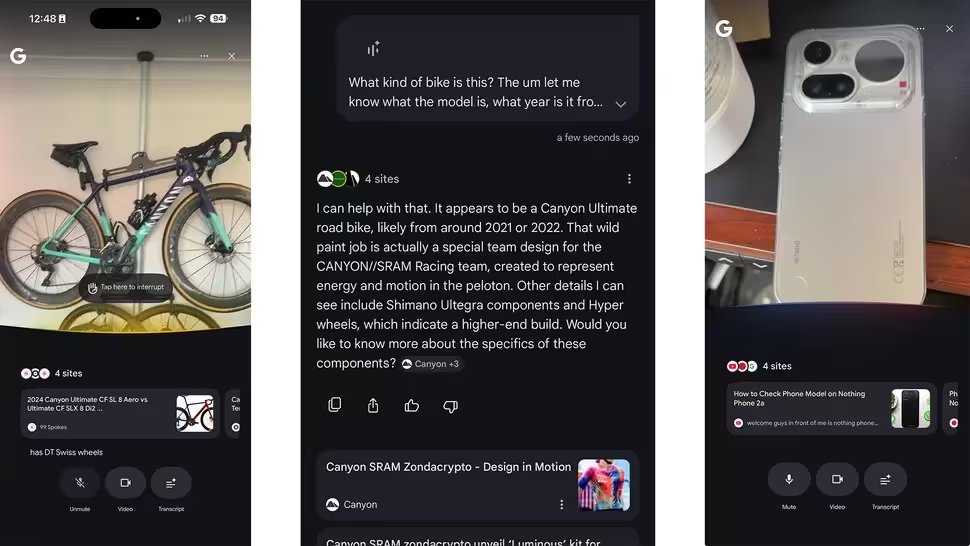

Sie richten Ihr Telefon auf etwas – ein Fahrrad, eine Waschmaschine, ein beliebiges Gerät – und fragen einfach. Kein Tippen. Kein Scrollen. Googles neuester Vorstoß will die Suche weniger wie ein Abfragefeld und mehr wie ein Gespräch in Echtzeit wirken lassen.

Search Live, Googles KI-gestützte konversationelle Suchfunktion, ist inzwischen still und leise auf über 200 Länder ausgeweitet und unterstützt 98 Sprachen. Ursprünglich Ende 2025 in den USA eingeführt, verbindet das Tool Kameraeingaben, Sprachinteraktion und KI-generierte Antworten zu einem einzigen, flüssigen Erlebnis. Es ist weniger „suchen“ und mehr „mit dem Internet reden“.

So funktioniert es in der Praxis: Öffnen Sie die Google-App, tippen Sie auf die Schaltfläche „Live“ und richten Sie die Kamera. Stellen Sie eine Frage laut – welches Modell ist dieses Gerät, wie funktioniert es, was sehe ich da – und das System antwortet sofort mit gesprochenen Antworten, inklusive Untertiteln. Dabei hört es weiter zu und ist bereit für Nachfragen, Klarstellungen oder sogar eine Richtungsänderung mitten im Gespräch.

Die Erfahrung basiert auf Gemini 3.1 Flash Live, einem neuen, sprachfokussierten Modell, das Google als von Natur aus mehrsprachig beschreibt. Das ist wichtiger, als es zunächst klingt. Statt nachträglich zu übersetzen, ist das Modell darauf ausgelegt, nativ in mehreren Sprachen zu denken und zu antworten, was Verzögerungen und holprige Formulierungen reduziert. Das Ergebnis: schnellere Antworten und ein spürbar natürlicherer Gesprächsfluss.

Wo es glänzt – und wo es stolpert

Unter der Haube setzt Search Live auf eine Technik, die als Query Fan-out bezeichnet wird. Anstatt eine Frage isoliert zu beantworten, greift es auf verwandte Anfragen und benachbarte Kontextinformationen zurück, um eine reichhaltigere Antwort zu formen. Deshalb wirken Antworten oft weniger starr und explorativer, selbst wenn die eigentliche Frage simpel ist.

Doch perfekt ist das System nicht. In Hands-on-Tests erkannte das Tool korrekt Objekte wie ein bestimmtes Fahrradmodell und erklärte sogar Design-Details wie die Lackierung. Dann gab es aber Fehler: Nachgerüstete Modifikationen wurden übersehen, Zubehörteile falsch interpretiert und gelegentlich griff das Modell auf veraltete Annahmen zur Serienausstattung zurück.

Dasselbe Muster tauchte anderswo auf. Ein neueres Smartphonemodell wurde für eine ältere Version gehalten, und im Vergleich mit Gemini Live waren die Antworten nahezu identisch – ein Hinweis darauf, dass beide Werkzeuge auf ähnliche Datenquellen zurückgreifen.

Solche Lücken sind nicht völlig überraschend. KI-Systeme dieser Art sind stark von verfügbaren Online-Informationen abhängig, was bedeutet, dass brandneue Produkte oder stark individualisierte Gegenstände sie verwirren können. Für alltägliche Fragen und allgemeine Objekterkennung hingegen hält das System in vielen Fällen gut durch.

Was diese Einführung interessant macht, ist nicht nur die Funktion selbst – sondern das Ausmaß. Google gibt an, dass Mitte 2025 mehr als 1,5 Milliarden Menschen bereits Lens nutzten, und Gemini Live etwa 750 Millionen Nutzer erreicht hatte. Search Live sitzt genau im Schnittpunkt dieser beiden Verhaltensweisen: Sehen und Fragen.

Wenn es global Anklang findet, könnte das die Art und Weise, wie Menschen suchen, grundlegend verändern. Weniger Tippen. Mehr Sprechen. Und vielleicht irgendwann weniger die Vorstellung, dass „Suche“ eine separate Handlung ist.

Technische Grundlagen: Query Fan-out und multimodale Verarbeitung

Die Kernidee hinter Query Fan-out besteht darin, eine einzelne Benutzerfrage als Ausgangspunkt für mehrere parallele Analysepfade zu verwenden. Anstatt nur direkt nach einer passenden Antwort zu suchen, generiert das System mehrere verwandte Unterfragen und zieht kontextuelle Hinweise heran – etwa ähnliche Produkte, typische Anwendungsfälle oder ergänzende Informationen aus Produktdatenbanken. In der Praxis bedeutet das, dass auch implizite Nutzerabsichten schneller aufgegriffen werden, weil das Modell verschiedene Interpretationswege zugleich prüft.

Gemini 3.1 Flash Live ist dabei nicht nur ein reiner Sprachgenerator: Es verarbeitet Audio, visuelle Eingaben und kontextuelle Metadaten synchron. Die Multimodalität erlaubt, dass visuelle Signale (Form, Farbe, Logos) direkt mit sprachlichen Mustern (Modelnamen, Herstellerspezifika) verknüpft werden. Das reduziert Latenzen, da weniger Schritte für Übersetzung oder separate Bild- und Textanfragen nötig sind. Für Entwickler und Produktmanager ist das ein wichtiger Fortschritt, weil es Interaktionen natürlicher und unmittelbarer macht.

Praktische Anwendungsfälle im Alltag

Die Bandbreite der Anwendungen reicht vom einfachen Produkt- und Objekterkennungsszenario bis zu komplexeren Hilfestellungen:

- Produkterkennung beim Einkaufen: Schnell Modellnummern, Kompatibilitäten und Preisvergleiche abrufen, ohne einen Barcode scannen zu müssen.

- Heimwerker- und Reparaturhilfe: Teile identifizieren, kurze Erklärungen zum Einbau oder Pflegehinweise geben.

- Reise und Orientierung: Sehenswürdigkeiten, Straßenschilder oder Hinweisschilder in einer Fremdsprache erkennen und direkt übersetzen.

- Barrierefreiheit: Menschen mit Sehbeeinträchtigungen können Informationen auditiv erhalten und per Follow-up-Fragen präzisieren.

In all diesen Szenarien liefert Search Live nicht nur eine einmalige Antwort, sondern erlaubt einen fortlaufenden Dialog: Nachfragen zu Details, Bitten um Beispiele oder die Aufforderung, Quellen anzugeben, sind Teil derselben Konversation.

Einschränkungen, Fehlerquellen und Bias-Risiken

Trotz der Fortschritte gibt es mehrere technische und konzeptionelle Grenzen:

- Datenabhängigkeit: Modelle spiegeln die Verfügbarkeit und Qualität online zugänglicher Informationen wider. Nischenprodukte oder interne Modifikationen finden sich oft nicht in der Trainings- oder Indexbasis.

- Visuelle Ambiguität: Bestimmte Materialien, reflektierende Oberflächen oder verdeckte Markenzeichen erschweren die Objekterkennung.

- Sprachliche Nuancen: Mehrdeutige Fragen ohne ausreichend visuelle Hinweise können zu Fehlinterpretationen führen.

- Systematische Verzerrungen (Bias): Wenn Datenquellen unausgewogen sind, entstehen fehlerhafte oder stereotype Antworten, die besonders bei kulturell sensiblen Inhalten problematisch werden können.

Um diese Risiken zu mindern, kombinieren die Entwickler heuristische Prüfungen mit Nutzerrückmeldungen und laufendem Nachtraining. Dennoch bleibt ein Restrisiko, das vor allem bei sicherheitskritischen Anwendungen beachtet werden muss.

Datenschutz, Privatsphäre und Nutzereinwilligung

Ein wichtiges Diskussionsthema ist der Umgang mit sensiblen Daten, die per Kamera und Mikrofon erfasst werden. Google betont in der Kommunikation meist, dass Aufnahmen lokal verarbeitet oder nur mit ausdrücklicher Zustimmung in die Cloud hochgeladen werden. Dennoch entstehen folgende pragmatische Fragen, die Nutzer und Regulierer interessieren:

- Wer hat Zugriff auf temporäre Audiodaten und Bildausschnitte?

- Wie lange werden Nutzungsdaten gespeichert und zu welchem Zweck?

- Welche Möglichkeiten haben Anwender, erstellte Interaktionsprotokolle einzusehen und zu löschen?

Für Unternehmen und Datenschützer bleibt Transparenz entscheidend: klare Opt-in-Prozesse, leicht zugängliche Datenschutzeinstellungen und eine verständliche Darstellung, was mit den Daten geschieht, sind zentrale Anforderungen, um Vertrauen aufzubauen.

Vergleich zu bestehenden Tools: Lens, Gemini Live und traditionelle Suche

Search Live stellt eine konvergente Nutzung von Google Lens und Sprach-KI dar. Während Lens primär visuelle Objekterkennung mit statischen Informationen kombinierte, bringt Search Live fortlaufende Sprachdialoge ins Spiel und nutzt ein stärker sprachbasiertes Modellverhalten durch Gemini 3.1 Flash Live. Gegenüber traditioneller Textsuche ergeben sich drei wesentliche Unterschiede:

- Modalität: Kombination aus Bild und Sprache statt reiner Texteingabe.

- Interaktivität: Fortlaufender Dialog mit Folgefragen statt einzelner Abfrage-Antwort-Zyklen.

- Reaktionsform: Gesprochene Antworten und Untertitel statt reinen Textresultaten auf einer Suchergebnisseite.

Für viele Nutzer kann das die Barriere zur Informationssuche deutlich senken, insbesondere in Situationen, in denen Tippen unpraktisch ist.

Skalierung, Infrastruktur und Kostenüberlegungen

Die globale Ausweitung auf über 200 Länder und fast 100 Sprachen ist nicht nur ein Produktupdate, sondern ein infrastrukturelles Kraftpaket. Echtzeit-Sprachantworten in Kombination mit Bildverarbeitung erfordern geringe Latenz, hohe Rechenleistung und robuste Netzwerkverbindungen. Aus technischer Sicht sind folgende Aspekte relevant:

- Edge-Processing: Teile der Verarbeitung werden an den Netzwerkrand (Edge) verlagert, um Latenz zu reduzieren und Bandbreite zu sparen.

- Modellkompression: Flash-Varianten von KI-Modellen sind oft so optimiert, dass sie mit weniger Rechenaufwand schnelle Antworten liefern.

- Kostenmodelle: Die Bereitstellung in großem Maßstab hat Auswirkungen auf Cloudkosten und Energieverbrauch; Anbieter kompensieren dies durch effiziente Infrastruktur und Priorisierung der lokal verfügbaren Rechenressourcen.

Für Unternehmen, die ähnliche Funktionalität integrieren wollen, sind diese Infrastrukturfragen bei der Architekturplanung entscheidend.

Zukunftsperspektiven: Wie sich Suchgewohnheiten ändern könnten

Langfristig könnte Search Live ein Baustein in einer Verschiebung sein, bei der Suchen zunehmend kontextualisiert, multimodal und dialogorientiert stattfinden. Einige mögliche Entwicklungen:

- Nahtlose Integration in AR-Brillen oder Wearables, sodass Informationen direkt ins Gesichtsfeld eingeblendet und sprachlich erklärt werden.

- Personalisierte Interaktionen, bei denen das Modell Vorlieben, wiederkehrende Fragen und kontextuelle Muster berücksichtigt, um proaktiv hilfreiche Informationen zu liefern.

- Ökosysteme von Drittanbietern, die spezialisierte Modelle für Medizin, Handwerk oder Industrie bereitstellen und so die Genauigkeit in Nischen verbessern.

Diese Entwicklungen würden die Grenze zwischen Suche, Assistenz und persönlicher Wissensbasis weiter verwischen.

Praktische Tipps für Nutzer

Wer Search Live effektiv nutzen möchte, kann einige einfache Strategien beachten:

- Klare Fragestellung: Präzise, konkrete Fragen führen in der Regel zu besseren Antworten.

- Mehrere Blickwinkel: Kurzes Umschwenken der Kamera oder ergänzende Nahaufnahmen können Details offenbaren, die das System sonst übersieht.

- Follow-up-Fragen nutzen: Da Search Live im Dialog bleibt, hilft es, Nachfragen zu stellen statt die Konversation neu zu starten.

- Quellen prüfen: Besonders bei kritischen Informationen sollten Nutzer die genannten Fakten mit weiteren Quellen abgleichen.

Mit diesen einfachen Gewohnheiten lässt sich die Trefferquote und der Nutzen im Alltag deutlich steigern.

Fazit: Evolution statt Revolution – aber mit großem Potenzial

Search Live ist nicht die vollständige Ablösung etablierter Suchparadigmen, aber es ist ein signifikanter Schritt in Richtung einer natürlicheren, multimodalen Informationsbeschaffung. Die Kombination aus lernfähiger Spracherkennung, leistungsfähiger Objekterkennung und einer auf Dialog ausgerichteten KI schafft in vielen Alltagsfällen einen unmittelbaren Mehrwert. Gleichzeitig bleiben technische Grenzen, Datenschutzfragen und Verzerrungsrisiken bestehen, die sorgfältig adressiert werden müssen.

Für Nutzer bedeutet das: Ein mächtiges Werkzeug zur schnellen Orientierung und Hilfe, solange die Grenzen des Systems verstanden und seine Ergebnisse kritisch geprüft werden. Für die Branche könnte der Erfolg von Search Live einen Wendepunkt markieren, an dem das Suchen zunehmend in den Hintergrund tritt und konversationsbasierte Interaktion zum Standard wird.

Kommentar hinterlassen